3行でわかる今回のニュース

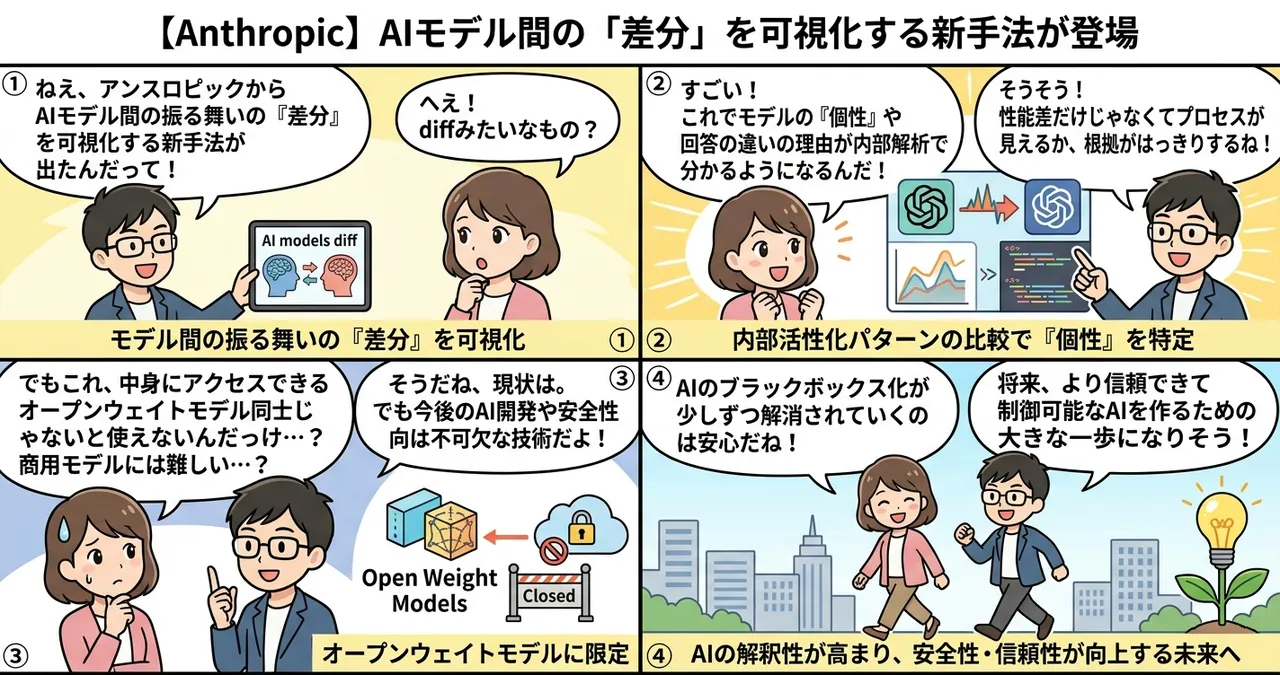

- AnthropicがAIモデル間の「行動の差分」を抽出する新しい手法を発表しました。

- ソフトウェア開発の「diff(差分比較)」の概念をAIの内部構造解析に応用しています。

- オープンウェイトモデル同士を比較することで、各モデル特有の振る舞いや特徴の特定が可能になります。

もうちょっと詳しく

ソフトウェア開発の「diff」をAI解析に

今回発表された研究は、プログラムのコード変更点を比較する際によく使われる「diff」コマンドの考え方を、AIの内部表現に適用したものです。複数のAIモデルに対し、同じ入力を行った際の内部的な活性化パターンを比較することで、モデルごとの「個性」や「違い」を浮き彫りにします。

これまでAIモデルの比較といえば、ベンチマークスコアによる性能評価が主流でした。しかし、本手法を用いることで、「なぜそのモデルがそのような回答をしたのか」という内部的な理由を、モデル間の差異という形でより具体的に突き止められるようになります。

なにがすごいの?

従来の手法と本手法の決定的な違いは、結果だけでなく「プロセス(内部表現)」の差に注目している点です。

| 比較項目 | 従来の手法(ベンチマーク) | 今回の手法(Diff解析) |

|---|---|---|

| 評価基準 | 正解率や回答速度 | 内部の活性化パターン(特徴量) |

| 可視化 | スコア(数値) | モデル特有の行動差分 |

| 目的 | 総合的な性能比較 | モデルの個性の特定と分析 |

これにより、ブラックボックス化しがちなAIの判断基準を、「このモデル特有の学習済み特徴量」として可視化できるようになります。これは、【Claude Opus 4.6】500以上のゼロデイ脆弱性を発見 — 「vibe working」時代の到来のような高度なAI解析技術とも親和性が高く、AIの安全性向上に大きく寄与するでしょう。

日本の開発現場への影響

日本のエンジニアにとっても、特定のタスクに対して「どのモデルが最適か」を判断する際、単なる勘やスコアに頼る必要がなくなります。自社で構築するAIシステムにおいて、特定のオープンウェイトモデルを採用する際の「根拠」を論理的に説明しやすくなるため、より信頼性の高いAIプロダクト開発が可能になるはずです。

また、【Claude Coworker】AIが「同僚」になる時代 — ソフトウェア株が下落した理由のようにAIを実務に組み込む際、モデル選定のプロセスがよりエンジニアリングの作法に近づいていくといえます。

ちょっと気になる点

この手法は非常に強力ですが、解析には相応の計算リソースと、内部状態にアクセス可能なオープンウェイトモデルであることが前提となります。クローズドな商用モデルに対して同様の解析を行うには障壁が高く、現段階では研究者や高度な開発コミュニティ向けのツールという側面が強いでしょう。また、抽出された「差分」が、実務上の回答精度にどれほど直接的に影響するのかを見極めるには、さらなる検証が求められます。

試してみたいポイント

- Anthropicの研究ブログを読み込み、具体的な比較アルゴリズムを確認する。

- 手元で利用可能なオープンウェイトモデルを2つ選び、特定のプロンプトに対する活性化パターンの違いをプロットしてみる。

- 比較結果から、モデルAがモデルBよりも特定のタスクで優れている理由を仮説立ててみる。

まとめ

AIのブラックボックス性を「差分」というエンジニアに馴染み深い概念で解き明かす、非常に実用的なアプローチです。今後、モデルの選定や最適化のプロセスが、より透明性の高い科学的な手法へと進化していくことが期待されます。

なぜ重要?

AIモデルの性能向上が加速する中で、モデルごとの「振る舞いの差異」を理解することは、安全性と信頼性を担保する上で不可欠です。本手法は、AIの内部構造を可視化することで、AIが判断を下す際の解釈性を高め、より制御可能なAI開発への道筋を示す重要な一歩となります。

一次ソース

用語メモ

- オープンウェイトモデル: モデルの重み(学習結果)が公開されており、誰でもダウンロードして実行や改変が可能なAIモデルのこと。

- 内部活性化: AIが情報を処理する際、ニューラルネットワーク内の各ノードがどの程度反応しているかを示す値。

- 特徴量: データの中にある、AIが学習や判断の材料にする重要な要素のこと。

- ブラックボックス: 内部の処理過程が複雑すぎて、人間にはなぜその結果に至ったのかが外から見えない状態。