3行でわかる今回のニュース

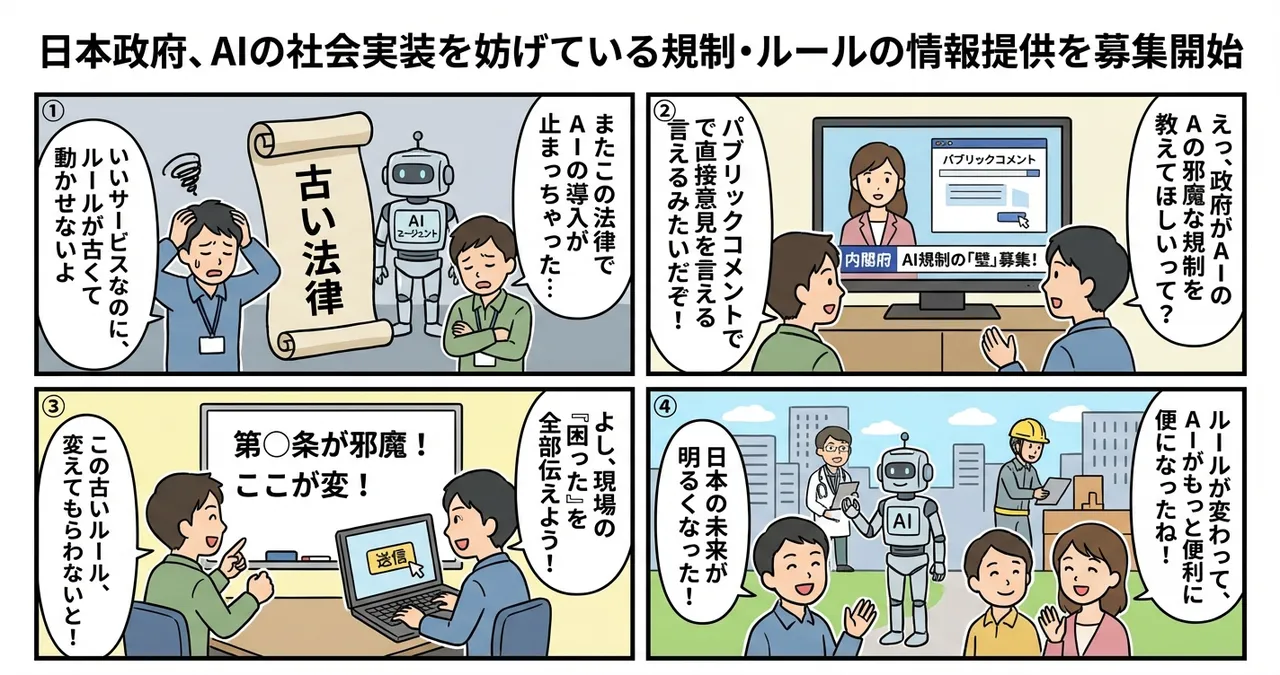

- 内閣府がAIの社会実装を妨げている規制やルールに関する意見募集を開始しました。

- LLMやAIエージェントの展開を阻む法律や省令を具体的に洗い出すのが目的です。

- 集まった意見は2026年後半の規制環境改善や「人工知能基本計画」の改定に反映されます。

もうちょっと詳しく

現場の「困った」を政府が直接ヒアリング

内閣府は2月10日、大規模言語モデル(LLM)や自律的に動くAIエージェントを社会に導入する際、ハードルとなっている法律やルールの情報を集めるパブリックコメントの募集を始めました。

これまでは「なんとなく法律が厳しそう」という漠然とした不安がありましたが、今回は「この法律の第○条が、AIのこの機能の実装を妨げている」といった、より具体的で実務的なフィードバックを求めているのが特徴です。

2026年後半に向けたロードマップ

今回の募集で集まった意見は、単にストックされるだけではありません。2026年後半に予定されている規制環境の抜本的な見直しや、政府の指針である「人工知能基本計画」の改定において、最優先事項として検討される予定です。スピード感を持って、技術の進化に法律を追いつかせようとする姿勢が見て取れます。

なにがすごいの?

今回の取り組みの意義は、政府が「技術の進化」を前提に、既存のルールをアップデートしようとしている点にあります。これまでの規制の多くは「人間が作業すること」を前提に作られていますが、そこをAI基準に書き換えるチャンスと言えます。

| 項目 | これまで | これから(期待される姿) |

|---|---|---|

| 規制のあり方 | 既存の法律にAIを無理やり当てはめる | AIの特性に合わせた柔軟なルール設計 |

| フィードバック | 専門家会議による検討が中心 | 開発者や企業からの実務的な意見を反映 |

| 実装スピード | 法解釈のグレーゾーンで足踏み | 明確なガイドラインによる迅速な展開 |

日本の開発現場への影響

日本のエンジニアや企業にとって、今回の動きは大きな追い風になります。

特に、医療、金融、建設といった「規制が厳しい業界」でAIソリューションを開発しているチームにとっては、現場で直面している不条理なルールを国に直接伝える貴重な機会です。グレーゾーンを恐れて開発を躊躇していた領域でも、ルールの明確化によって一気に投資や開発が進む可能性があります。

試してみたいポイント

- 内閣府の募集ページを確認する まずは、どのような形式で意見が求められているのか、e-Govなどの公的窓口をチェックしてみましょう。

- 自社の開発における「障壁」をリストアップする 「これ、法律的に大丈夫なんだっけ?」と議論が止まったポイントを、チーム内で整理してみるのがおすすめです。

- 2026年のロードマップを意識する 2026年後半にルールが変わることを想定し、中長期的な製品ロードマップを再検討してみるのも良いかもしれません。

まとめ

技術の進化が速すぎるあまり、法律が足かせになってしまうのは非常にもったいないことです。今回の募集を通じて、日本の開発現場がもっと自由に、もっと大胆に挑戦できる環境が整うことを期待しています。私も一人のユーザーとして、どのような新しいサービスが生まれてくるのか今から楽しみです。