3行でわかる今回のニュース

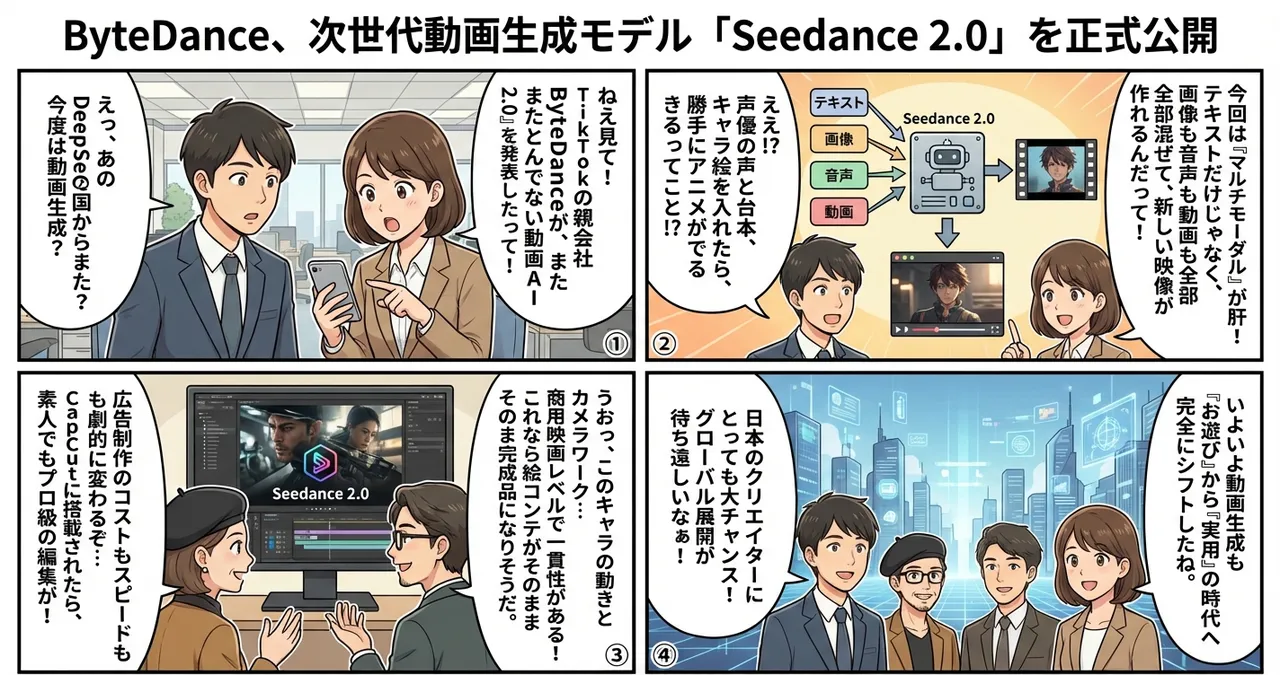

- TikTokの親会社ByteDanceが、最新の動画生成モデル「Seedance 2.0」を正式に公開しました。

- テキストだけでなく画像・音声・動画を同時に処理できるマルチモーダルな設計が最大の特徴です。

- プロの映画制作や広告業界向けに最適化されており、中国では「第二のDeepSeek」と称されるほどの衝撃を与えています。

もうちょっと詳しく

映像制作の常識を塗り替える「Seedance 2.0」

ByteDanceが満を持して発表した「Seedance 2.0」は、これまでの動画生成ツールの枠を超えた次世代の基盤モデルです。単に指示文(プロンプト)から映像を作るだけでなく、既存の画像や音声、さらには別の動画素材を組み合わせて、一貫性のある高品質な映像を書き出すことができます。

映画・広告業界への特化

今回のアップデートで注目すべきは、クリエイティブの現場で即戦力となるよう設計されている点です。キャラクターの動きやカメラワークの制御が非常に精密になっており、商用利用を強く意識した仕上がりになっています。

「第二のDeepSeek」と呼ばれる背景

中国国内では、先日世界を驚かせた推論モデル「DeepSeek」に続く、技術的ブレイクスルーとして大きな期待を寄せられています。ByteDanceが持つ膨大な動画データと計算リソースが、このモデルの精度を支えているのは間違いありません。

なにがすごいの?

Seedance 2.0の凄さは、その「理解力の深さ」にあります。従来のモデルでは難しかった、音声と映像の同期や、複雑な物理法則の再現が飛躍的に向上しました。

| 機能 | 従来の一般的なモデル | Seedance 2.0 |

|---|---|---|

| 入力ソース | 主にテキストのみ | テキスト・画像・音声・動画 |

| 一貫性 | 長尺になるとキャラが崩れやすい | 複雑なカットでも一貫性を維持 |

| 用途 | SNS向けの短いクリップ | 映画、テレビCM、プロの映像制作 |

| 処理速度 | 生成に時間がかかる | 独自アルゴリズムにより高速化 |

特に、音声データから話者の口の動きや表情を生成する能力は、吹き替えや多言語展開において強力な武器になりそうです。

日本の開発現場への影響

日本のクリエイティブ業界やエンジニアにとっても、このニュースは無視できません。

まず、広告代理店や制作プロダクションでは、絵コンテの段階から完成品に近いクオリティの試作が数分で作れるようになります。これにより、制作コストの大幅な削減とスピードアップが期待できるでしょう。

また、開発者視点では、ByteDanceが今後このモデルのAPIをどのように提供するかが注目ポイントです。もしCapCutなどの既存ツールと深く統合されれば、一般ユーザーでもプロ級の編集が当たり前になる世界がやってきます。日本独自のコンテンツ(アニメや特撮など)との相性も気になるところですね。

試してみたいポイント

現時点では中国国内向けの展開が先行していますが、私たちが今後チェックすべきアクションをまとめました。

- デモ動画のクオリティをチェック: 公式サイトやSNSで公開されているサンプルを見て、物理演算の正確さを確認してみましょう。

- CapCutのアップデートに注目: ByteDance傘下の編集アプリにこの技術が搭載される可能性が高いため、こまめに更新を確認。

- マルチモーダル入力の準備: テキストだけでなく、音声や画像を組み合わせた「指示の出し方」を今のうちからイメージしておくと良さそうです。

まとめ

ByteDanceのSeedance 2.0は、動画生成が「お遊び」から「実用」へと完全にシフトしたことを象徴する出来事といえます。映像制作のハードルが下がる一方で、作り手のセンスがより問われる時代になりそうです。今後のグローバル展開が待ち遠しいですね。