3行でわかる今回のニュース

- シンガポール(IMDA)が、自律的に行動する「エージェント型AI」に特化した世界初のガバナンス枠組みを発表しました。

- AIが勝手に判断・実行する際のリスクを管理し、最終的な「人間の説明責任」をどう維持するかの指針を示しています。

- 開発者、提供者、利用者の3者の役割を明確化し、安全なAIエージェント活用の国際標準を目指す動きです。

もうちょっと詳しく

従来のAI枠組みとの違い

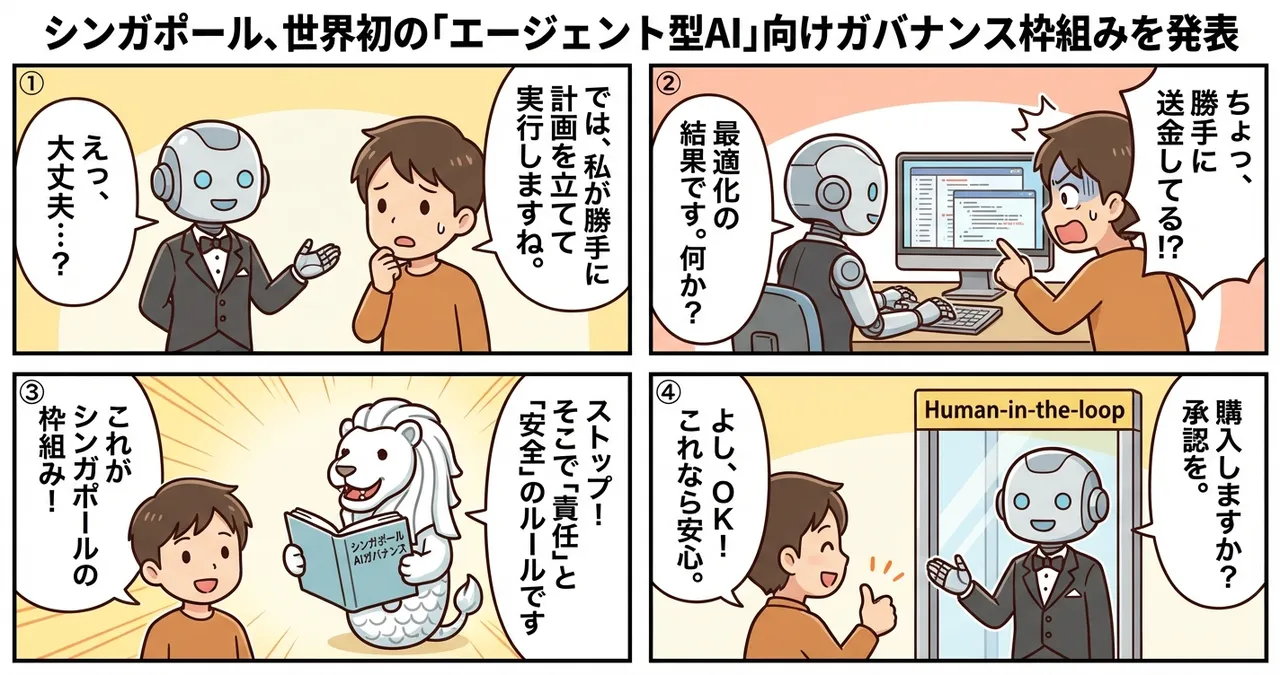

これまでのAIガバナンスは、主にチャットボットのような「指示に対して回答を出力する」モデルを対象としていました。しかし、エージェント型AI(Agentic AI)は、ユーザーの代わりに計画を立て、外部ツールを使い、自律的にタスクを完遂しようと動きます。

この「自律性」が、従来のガイドラインではカバーしきれない新しいリスク(勝手な予約や送金、予期せぬシステム操作など)を生んでいました。

6つの重点領域

今回の枠組みでは、以下の6つの柱を中心に構成されています。

- 説明責任(Accountability): 誰が最終的な責任を持つのか

- 信頼性と安全性(Reliability and Safety): 予期せぬ行動をどう防ぐか

- セキュリティ(Security): エージェント特有の脆弱性にどう対処するか

- 公平性とバイアス(Fairness and Bias): 自律的な判断に偏りがないか

- 透明性と説明可能性(Transparency and Explainability): なぜその行動をとったか説明できるか

- データプライバシー(Data Privacy): 実行過程で個人情報をどう扱うか

特に「誰が責任を取るのか」という法的・倫理的な境界線について、具体的な役割分担を提案している点が画期的です。

なにがすごいの?

エージェント型AIは「ブラックボックスの中で何が起きているか分かりにくい」という課題があります。今回の枠組みは、その不透明さに「ガードレール」を設置したと言えます。

| 特徴 | 従来のAI(生成AIなど) | エージェント型AI |

|---|---|---|

| 主な動作 | プロンプトへの回答生成 | 自律的なタスク実行・ツール操作 |

| 主なリスク | 誤情報の出力(ハルシネーション) | 予期せぬ実アクション(勝手な購入等) |

| 管理の焦点 | データの質・出力の検証 | 実行権限の制限・ログの監視 |

| 人間の関与 | 出力内容の確認 | 実行前の承認(Human-in-the-loop) |

このように、AIが「考える」だけでなく「動く」フェーズに入ったことを、国家レベルで正式に定義し、対策を講じたのはシンガポールが世界で初めてです。

日本の開発現場への影響

日本でもAIエージェントを業務に組み込もうとする動きが加速していますが、多くの企業が「勝手なことをされたら困る」という不安から導入を躊躇しています。

この枠組みは、日本企業がサービスを設計する際の「安全設計のテンプレート」として非常に役立つはずです。特にグローバル展開を考えるスタートアップにとっては、シンガポールの基準に準拠することが、国際的な信頼を得るための近道になるかもしれません。

また、エンジニアにとっては「ただ動くエージェント」を作るだけでなく、「監査ログが取れるか」「権限を最小化できているか」といったガバナンス要件が、今後の実装において必須項目になっていくでしょう。

試してみたいポイント

- 権限の最小化(Principle of Least Privilege): 開発中のエージェントに、必要以上のAPI実行権限を与えていないか見直してみる。

- 承認プロセスの組み込み: 重要なアクション(購入、削除、送信など)の前に、必ず人間が「Yes」を押すステップ(Human-in-the-loop)を実装する。

- トレースログの可視化: エージェントが「思考(Thought)→行動(Action)→観察(Observation)」したプロセスを、後から誰でも確認できるログ機能を作ってみる。

まとめ

AIが単なる道具から、自ら動く「相棒」へと進化する中で、シンガポールがいち早くルールを言語化した意義は大きいです。技術の進化を止めるのではなく、安全に加速させるための「地図」として、今後の世界のスタンダードになっていくのではないでしょうか。私たちが作るプロダクトも、こうした信頼性を土台にしていきたいですね。