3行でわかる今回のニュース

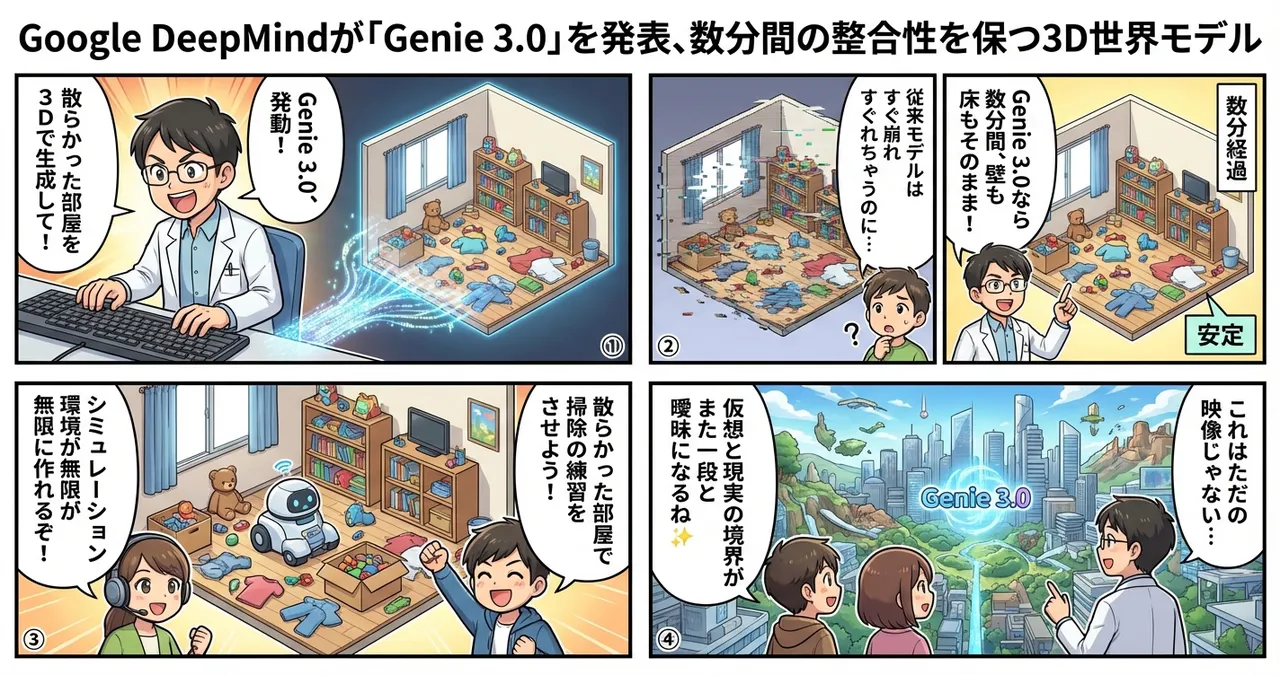

- テキストから操作可能な3D環境を生成できる世界モデル「Genie 3.0」が発表されました。

- 従来のモデルでは困難だった「数分間にわたる物理的整合性」を維持したまま、空間を生成し続けられます。

- ロボットの強化学習やゲーム開発におけるシミュレーション環境の自動構築を劇的に進化させる可能性があります。

もうちょっと詳しく

Google DeepMindが発表した「Genie 3.0」は、私たちが言葉で指示した通りの3D空間を作り出し、その中を自由に動き回れるようにする「世界モデル」の最新版です。

途切れない「世界の記憶」

これまでの動画生成や空間生成技術では、数秒から数十秒経つと、さっきまであった壁が消えたり、床の質感が変わったりといった「矛盾」が生じることが一般的でした。しかし、Genie 3.0は数分間にわたって一貫した物理法則とオブジェクトの配置を維持できます。

インタラクティブな体験

単に綺麗な映像を作るだけでなく、ユーザーの入力(操作)に対してリアルタイムに反応するのが特徴です。例えば「森の中を歩く」という指示で生成された空間で、木を避けて右に曲がれば、それに応じた新しい景色が物理的に正しく描画されます。

なにがすごいの?

一番のポイントは、生成された空間の「安定感」と「持続性」です。動画生成モデルとGenie 3.0の違いを比較してみましょう。

| 特徴 | 従来の動画生成モデル | Genie 3.0 |

|---|---|---|

| 主な用途 | 観賞用の動画作成 | インタラクティブな空間操作 |

| 継続時間 | 数秒〜数十秒で破綻しやすい | 数分間の整合性を維持 |

| 物理法則 | 見た目重視(フェイクが多い) | 物理的整合性を重視 |

| 操作性 | 基本的に不可 | リアルタイム操作が可能 |

このように、Genie 3.0は「映像を作る道具」というよりも「仮想現実をその場で構築するエンジン」に近い性質を持っています。

日本の開発現場への影響

この技術は、特に製造業やロボティクスが盛んな日本の産業界にとって大きな武器になりそうです。

現在、ロボットに新しい動きを教え込むには、精巧な3Dモデル(デジタルツイン)を人間が手作業で作るか、高価なシミュレーターを用意する必要があります。Genie 3.0を使えば、「散らかった部屋で掃除をするロボットの環境」をテキスト一つで無限に生成し、その中でAIをトレーニングできるようになります。

また、ゲーム開発においても、広大なオープンワールドのプロトタイプを数分で作成できるため、企画段階のスピード感が一気に加速するでしょう。

試してみたいポイント

現時点では研究発表の段階ですが、公開された情報から私たちが注目すべきアクションをまとめました。

- デモ動画で「物体の一貫性」を確認する: プロジェクトページ(GitHub.io)で、カメラが一周回っても同じ場所に同じ物が置かれているかチェックしてみてください。

- 世界モデル(World Models)の概念を理解する: 単なる画像生成とは異なる「物理法則の学習」という考え方に触れておくと、今後のトレンドを追いやすくなります。

- 自社のシミュレーション課題を洗い出す: 「もし、こんな環境が言葉で作れたら、どの開発プロセスが楽になるか」を想像してみるのがおすすめです。

まとめ

Genie 3.0の登場によって、AIが「映像を見る」段階から「一貫した世界を構築し、その中で活動する」段階へ進んだことを強く実感します。数分間の整合性が保てるようになったことで、実用的なシミュレーションとしての価値がぐっと高まりました。仮想空間と現実世界の境界線が、また一段と曖昧になっていきそうですね。✨

copyright: © 2026 4コマAIニュース