3行でわかる今回のニュース

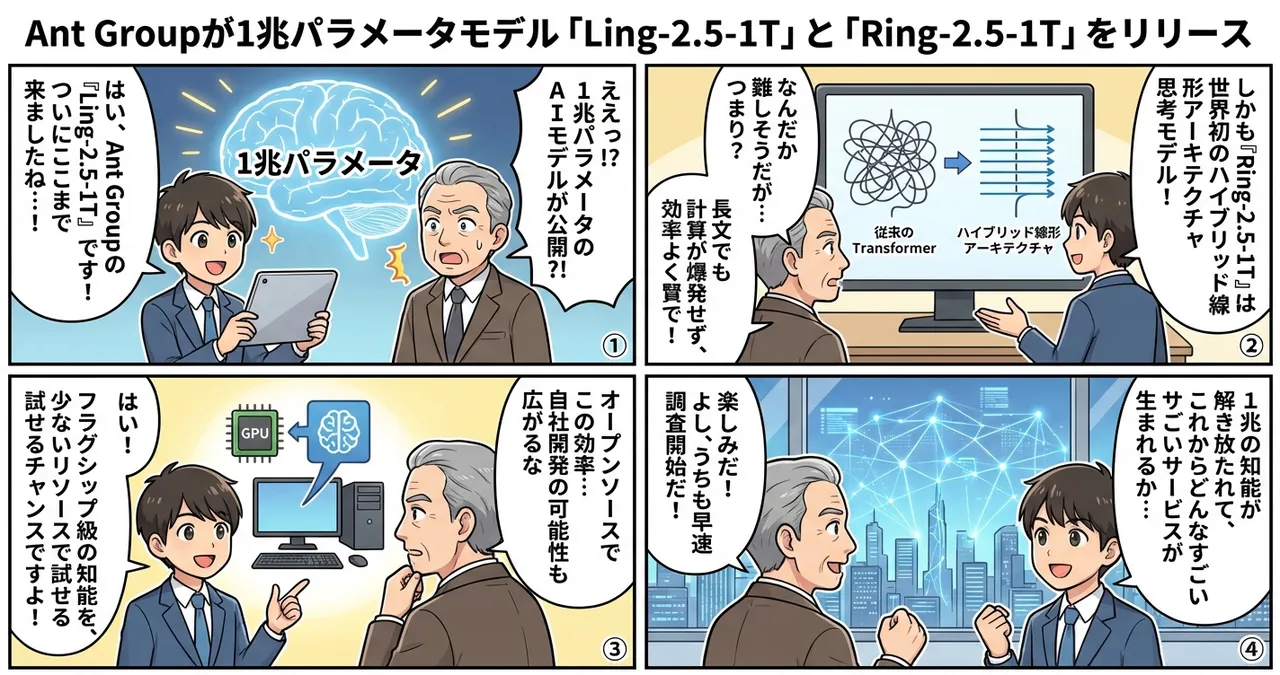

- Ant Groupが、1兆パラメータ規模の超大型モデル「Ling-2.5-1T」と「Ring-2.5-1T」を公開しました。

- 「Ring-2.5-1T」は世界初のハイブリッド線形アーキテクチャを採用した思考モデルで、推論効率が大幅に向上しています。

- 1兆規模のフラグシップ級モデルがオープンソースで提供されることにより、開発の民主化がさらに進むと期待されます。

もうちょっと詳しく

1兆パラメータ時代の幕開け

Alipayなどを運営するAnt Groupが、自社開発のAIモデルファミリーの最新版として、1兆(1 Trillion)パラメータという驚異的なスケールのモデルをリリースしました。今回発表されたのは、汎用的な大規模言語モデル(LLM)である「Ling-2.5-1T」と、より高度な推論(Reasoning)に特化した「Ring-2.5-1T」の2種類です。

これまで、1兆パラメータを超えるような「超大型モデル」は、大手テック企業のクローズドな環境で運用されるのが一般的でした。しかし、Ant Groupはこれらをオープンソースとして公開することで、コミュニティ全体での技術革新を促す姿勢を見せています。

ハイブリッド線形アーキテクチャの正体

特に注目すべきは「Ring-2.5-1T」に採用された「ハイブリッド線形アーキテクチャ」です。これは従来のTransformerモデルが抱えていた「入力が長くなるほど計算量が爆発的に増える」という課題を解決するための技術です。線形注意機構(Linear Attention)などを組み合わせることで、1兆パラメータという巨体でありながら、実用的な速度での推論を可能にしています。

なにがすごいの?

今回のリリースの凄さは、その「規模」と「効率」の両立にあります。MetaのLlama 3.1(405B)といった既存のオープンソースモデルと比較しても、パラメータ数において圧倒的な差をつけています。

| モデル名 | パラメータ数 | 主な特徴 |

|---|---|---|

| Ling-2.5-1T | 1兆 | 汎用性能が高く、推論効率を極限まで最適化 |

| Ring-2.5-1T | 1兆 | 世界初のハイブリッド線形アーキテクチャ思考モデル |

| Llama 3.1 405B | 4050億 | 従来のオープンソース界のリーダー的存在 |

単に大きいだけでなく、ハイブリッドアーキテクチャによって「計算リソースの消費を抑えつつ、1兆パラメータの知能を引き出す」ことに成功している点が、技術的な大きなブレイクスルーと言えます。

日本の開発現場への影響

日本のエンジニアや企業にとって、この規模のモデルが自由に触れる形で提供される意味は小さくありません。

- プライベートクラウドでの運用検討: 1兆パラメータを動かすには相応のハードウェアが必要ですが、効率化されたアーキテクチャにより、以前よりも少ないGPUリソースでフラグシップ級の知能を自社環境に構築できる可能性があります。

- 日本語特化モデルのベース: この巨大な知能をベースに、日本語データの追加学習(継続事前学習)を行うことで、これまでにない高性能な国産・日本市場向けAIが誕生するかもしれません。

- 推論コストの低下: 効率的なアーキテクチャの知見が広まることで、API経由で利用する際のコストや、自社サーバーで運用する際の電気代削減にもつながります。

試してみたいポイント

この巨大なモデルを体感するために、以下のステップでチェックしてみるのがおすすめです。

- Hugging Face等の公式リポジトリを確認: モデルの重みやライセンスの詳細をチェックしましょう。

- 長文コンテキストのテスト: ハイブリッド線形アーキテクチャの恩恵を確認するために、あえて長大なドキュメントを読み込ませて処理速度を測ってみてください。

- 量子化版の待機: 1兆パラメータをそのまま動かすのは大変ですが、コミュニティによる量子化(GGUF形式など)が進めば、より現実的な環境でテストできるようになります。

まとめ

1兆パラメータの知能が「誰でも使える」形で解き放たれたことは、AI開発の歴史において非常に大きな転換点になりそうです。この巨大なパワーが、今後どのようなアプリケーションやサービスとして私たちの生活に溶け込んでくるのか、期待が膨らみますね。 💡