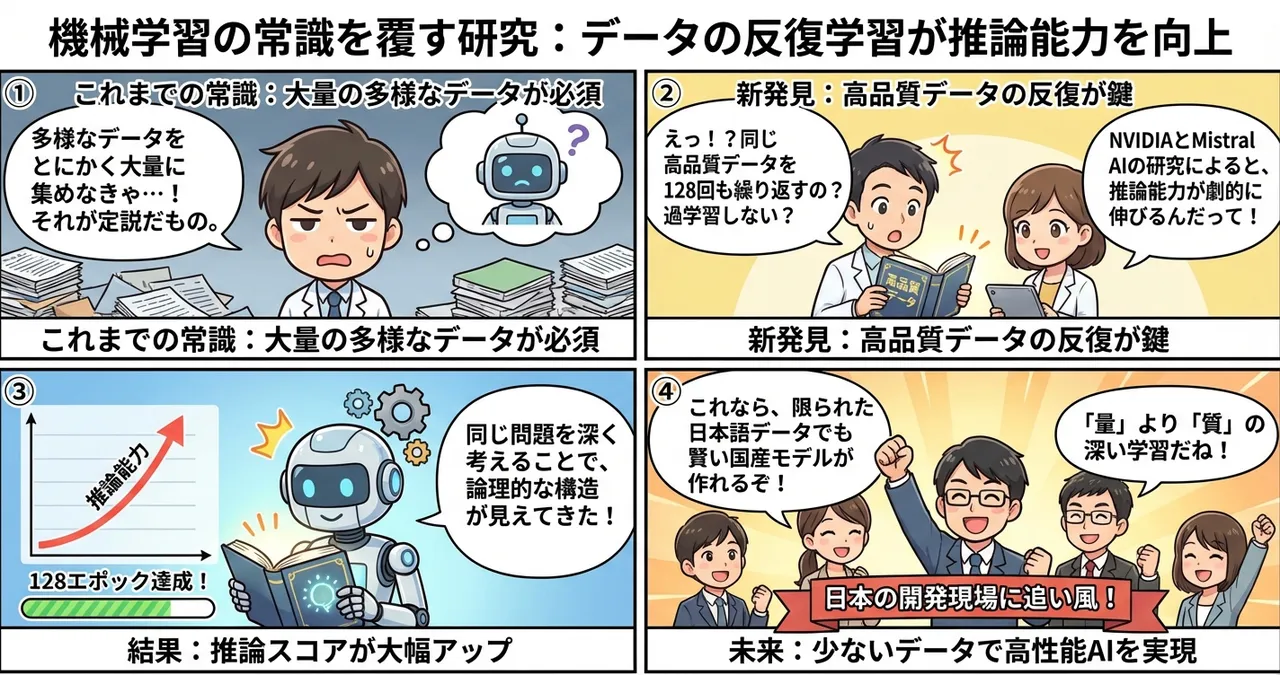

3行でわかる今回のニュース

- 高品質な少数のデータを何度も繰り返し学習させることで、推論能力が大幅に向上。

- 128エポック(繰り返し)という、従来の常識を覆す回数でも精度が伸び続けることが判明。

- 推論ベンチマークで12〜26ポイントもスコアが改善し、モデルの「賢さ」を効率的に引き出せる。

もうちょっと詳しく

繰り返しのタブーを打ち破る発見

これまでの大規模言語モデル(LLM)の学習では、「同じデータを何度も見せると過学習(丸暗記)が起きて汎用性が失われる」というのが定説でした。そのため、いかに多様で膨大なデータを集めるかに焦点が当てられてきたのです。

しかし、NVIDIAとMistral AIの研究チームが発表した論文は、この常識を鮮やかに覆しました。彼らは、数学的な問題や論理的思考を必要とする「高品質なデータ」に限り、最大128回も繰り返し学習(エポック)を回したところ、モデルの推論能力が右肩上がりに向上することを発見しました。

スケーリング則の新しい形

この研究では、データの量(ボリューム)を増やすことよりも、データの質(クオリティ)を重視し、それを「深く」学習させることの重要性が示されています。特に推論能力が求められるタスクにおいて、この「繰り返し学習」は非常に強力な武器になるようです。

なにがすごいの?

今回の研究の衝撃的な点は、データセットのサイズを拡大せずとも、学習の回数を増やすだけでベンチマークスコアが劇的に向上したことです。

| 評価指標 | 多様なデータ(1回学習) | 高品質データ(繰り返し学習) | スコアの差 |

|---|---|---|---|

| 推論ベンチマーク | ベースライン | +12〜26ポイント | 大幅向上 |

| 計算リソース効率 | 低い(大量のデータが必要) | 高い(少量のデータで済む) | 効率化 |

単に「覚える」だけでなく、繰り返し学習を通じて論理的な構造やパターンをより深く理解している可能性が示唆されています。これは、計算リソースが限られている状況でも、モデルを賢くできる可能性を秘めています。

日本の開発現場への影響

日本の企業やエンジニアにとって、このニュースは大きな追い風になるかもしれません。

日本語の高品質なデータセットは、英語に比べればどうしても数が限られています。これまでは「データが足りないから海外モデルには勝てない」と諦めていた場面でも、厳選した高品質な日本語データを徹底的に繰り返し学習させることで、特定の領域で非常に高い推論能力を持つ国産モデルを作れる道が見えてきました。

膨大なクロールデータに頼るのではなく、「良いデータをどう深く学ばせるか」という職人芸的なアプローチが、今後の開発の鍵になりそうです。

試してみたいポイント

自分のプロジェクトや研究で取り入れられそうなアクションをまとめました。

- データの選別を最優先にする: 質の低いデータを100万件集めるより、宝石のような1万件を特定する。

- エポック数の固定概念を捨てる: 1〜3エポックで止めていた学習を、高品質データに絞って10回、20回と増やして推論精度の変化を見る。

- 推論特化のファインチューニング: 特定の業務知識を深く理解させたい場合、この繰り返し手法が特効薬になる可能性があります。

まとめ

「量こそ正義」だったLLMの学習トレンドに、一石を投じる面白い研究結果でした。 同じ本を何度も読み返すことで深い理解が得られる人間のように、AIもまた「熟読」することで真の知性を獲得していくのかもしれませんね。