3行でわかる今回のニュース

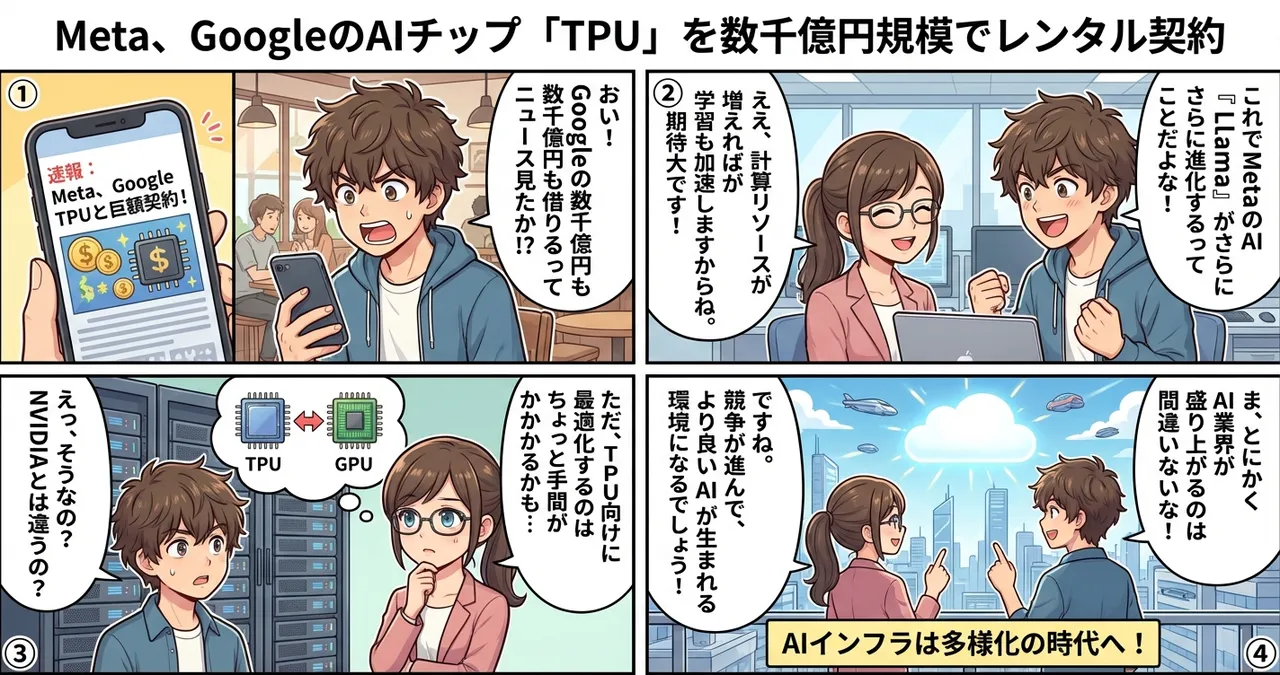

- MetaがGoogleの独自AIチップ「TPU」を数千億円規模で利用する大規模な契約を締結しました。

- 次世代のLlamaモデルなどのトレーニングと推論に活用し、計算リソースを大幅に拡充します。

- 特定ベンダー(NVIDIA)への過度な依存を避け、インフラの多様化とコスト最適化を図る戦略的な一手です。

もうちょっと詳しく

Meta(旧Facebook)が、競合他社ともいえるGoogleとの間で、異例ともいえる巨額のインフラ契約を結びました。この契約は、Googleが独自に開発したAI特化型プロセッサ「TPU(Tensor Processing Unit)」を、Google Cloudを通じて数千億円(数十億ドル)規模でレンタルするという内容です。

これまでMetaは、自社データセンターの構築やNVIDIA製GPUの大量購入に注力してきましたが、AIモデルの巨大化に伴い、計算リソースの確保が最優先課題となっています。今回の提携により、MetaはGoogleの高度なAIインフラを即座に活用できるようになり、次世代の大規模言語モデル(LLM)の開発を加速させる狙いがあるのでしょう。

また、Meta自身も独自のAIチップ「MTIA」の開発を進めていますが、現時点ではGoogleの成熟したTPUエコシステムを併用することが、スピードと効率の両面で合理的であると判断した形です。

なにがすごいの?

今回のニュースの核心は、AIインフラにおける「脱NVIDIA」の動きが、テックジャイアント間でも本格化している点にあります。以下の表は、一般的なGPUとGoogleのTPUの違いをまとめたものです。

| 特徴 | NVIDIA GPU (H100等) | Google TPU (v5p等) |

|---|---|---|

| 設計思想 | 汎用的な並列計算 | AI(行列演算)に特化 |

| 入手性 | 需要過多で入手困難な時期がある | Google Cloud経由で柔軟に確保可能 |

| 電力効率 | 高い(が汎用性ゆえのロスあり) | AIワークロードにおいて極めて高い |

| 主な用途 | 開発、学習、推論全般 | 大規模モデルの高速学習・推論 |

TPUは、特定のニューラルネットワーク処理に最適化されているため、大規模な学習において電力効率やコストパフォーマンスで優位に立つケースが多く見られます。Metaのような巨大企業がこれを採用することは、TPUがNVIDIA製品の強力な代替選択肢として完全に定着したことを意味します。

日本の開発現場への影響

日本のエンジニアや企業にとっても、このニュースは「マルチクラウド・マルチチップ戦略」の重要性を示す好例となります。

- 計算リソースの選択肢拡大: 特定のハードウェアに依存せず、TPUなどの代替リソースを活用するノウハウの価値が高まります。

- Llamaモデルの進化: Metaの学習環境が強化されることで、日本語対応を含む次世代Llamaモデルのリリースサイクルが早まる可能性があります。

- コスト構造の変化: 大手企業のインフラ多様化が進めば、長期的にはAIコンピューティング全体の価格競争が進み、日本のスタートアップ等もより安価にリソースを確保できる環境が整うかもしれません。

ちょっと気になる点

一方で、いくつかの課題も指摘されています。まず、NVIDIAのCUDA(開発環境)に慣れ親しんだエンジニアにとって、TPU向けの最適化には一定の学習コストがかかる点です。MetaはPyTorchなどのフレームワークを通じてこれを共通化しようとしていますが、ハードウェアの特性を最大限引き出すには固有の調整が欠かせません。

また、Googleのクラウドサービスへの依存度が高まることで、将来的な「ベンダーロックイン」のリスクもゼロではありません。数千億円規模の契約となれば、その後の移行は容易ではないため、Metaがどのように主導権を維持し続けるかが注目されます。

試してみたいポイント

Metaのような大規模な投資は難しくても、個人や小規模チームでTPUの恩恵を受ける方法はすでに存在します。

- Google ColabでのTPU利用: 無料版や安価な有料版でも、ランタイムタイプをTPUに変更することで、その高速な処理を体験できます。

- PyTorch XLAの学習: TPUでPyTorchを動かすためのライブラリ「XLA」に触れておくと、将来的なインフラの選択肢が広がります。

- Google Cloudの無料枠活用: Google Cloud Platform(GCP)の新規登録特典などを利用して、実際のTPUノードを立ち上げてみるのも良い経験になるでしょう。

まとめ

MetaによるGoogle TPUの巨額契約は、AI開発における「計算資源の確保」がもはや一企業の枠を超えた国家・産業レベルの争奪戦であることを裏付けています。NVIDIA一強の時代から、自社チップや競合他社のリソースを巧みに組み合わせる「ハイブリッド・インフラ」の時代へと、AI業界のフェーズが確実に移行しているといえます。

なぜ重要?

AIモデルの性能が投入する計算量に比例する現代において、特定のサプライヤーにリソースを依存することは最大の経営リスクです。今回の提携は、テック巨頭同士が手を取り合うことで、AIインフラの独占状態を打破し、開発の継続性を担保しようとする歴史的な転換点といえます。

一次ソース

用語メモ

- TPU (Tensor Processing Unit): Googleが開発したAI処理専用のプロセッサ。特定の数学的演算に特化することで、高速かつ省電力な学習・推論を実現します。

- 推論 (Inference): 学習済みのAIモデルに新しいデータを入力し、予測や回答を導き出すプロセス。チャットAIの回答生成などがこれにあたります。

- Llama: Metaが開発・公開しているオープンな大規模言語モデル。世界中の開発者に利用されており、今回の契約による性能向上が期待されています。

- ベンダーロックイン: 特定のメーカーやサービス提供者の技術に依存しすぎることで、他社製品への乗り換えが困難になる状態を指します。