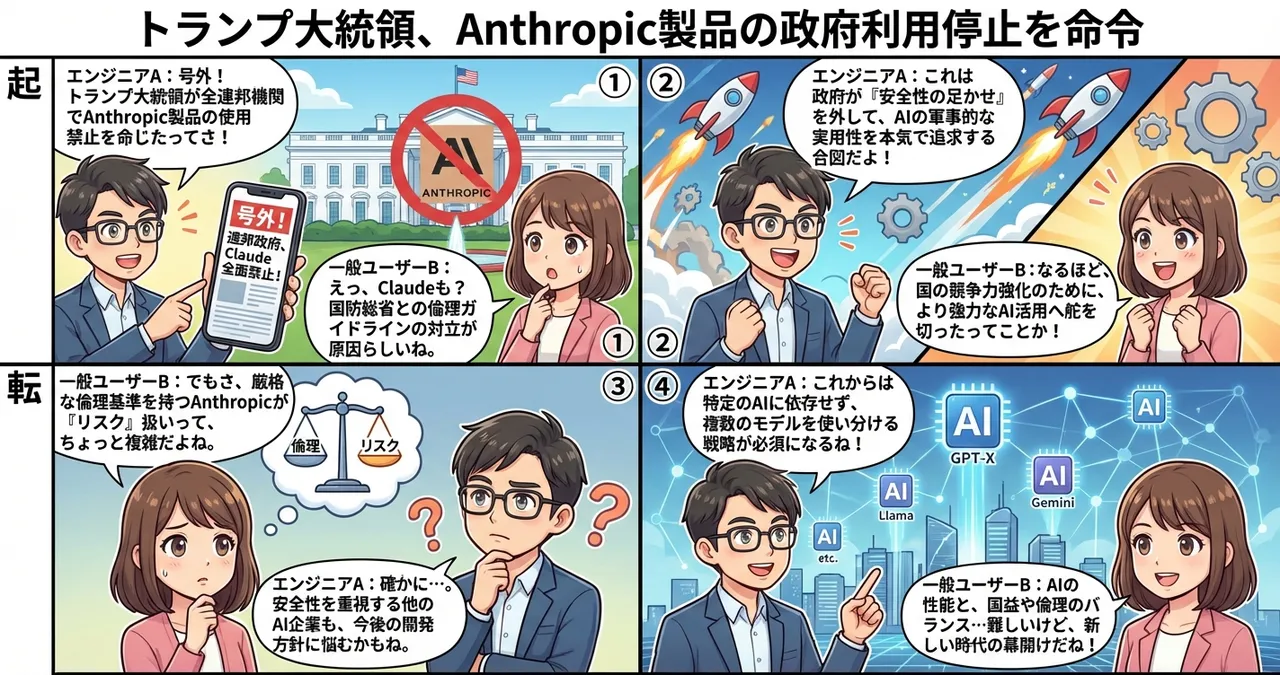

3行でわかる今回のニュース

- トランプ大統領が、全連邦機関に対してAnthropic社の技術利用を即時停止するよう命じました。

- 国防総省が求めていたAI倫理ガイドラインの緩和を同社が拒否したことが、今回の強硬策の直接的な引き金です。

- 同社を「サプライチェーンのリスク」に指定する方針であり、安全保障上の懸念が公式に表明されています。

もうちょっと詳しく

今回の事態は、数日前に報じられた【Claude】米国国防総省がAnthropicのCEOを召喚、軍事利用の制御を巡り議論が激化というニュースの続報ともいえる、極めて深刻な展開です。

米国防総省(ペンタゴン)は以前から、軍事的な意思決定やシミュレーションにおいて、Anthropicが設けている厳格な「安全性の制限(ガードレール)」が障害になっていると主張してきました。これに対し、同社は「Constitutional AI(憲法的AI)」という独自の哲学に基づき、倫理的な制約を緩めることを拒否し続けてきました。

トランプ大統領はこの姿勢を「国家安全保障に対する非協力的な態度」と見なし、大統領令を発令。これにより、国防総省のみならず、エネルギー省や商務省など、すべての連邦政府機関からAnthropicの製品(Claudeシリーズなど)が排除されることになります。さらに、同社を特定の外国企業と同様の「サプライチェーン・リスク」として扱う方針を固めたことで、民間企業への波及も避けられない情勢といえるでしょう。

なにがすごいの?

今回のニュースが持つ衝撃は、単なる一企業の排除に留まりません。政府が「AIの安全性」よりも「軍事的な実用性」を優先するという明確なメッセージを発した点にあります。

| 比較項目 | Anthropicの姿勢(従来) | 米政府の要求 |

|---|---|---|

| 倫理制限 | 憲法的AIに基づき、攻撃的利用を厳格に制限 | 軍事作戦や武器制御への応用を許可する柔軟性 |

| 透明性 | モデルの安全性評価を重視 | 政府による内部アルゴリズムへの優先アクセス |

| 政府との関係 | 独立した安全性研究機関としての性格 | 国益に直結する技術インフラとしての役割 |

このように、民間企業が提唱する「AIの安全性」と、国家が求める「技術的優位性」が真っ向から衝突した形です。技術的な観点で見れば、どれだけ高性能なモデルであっても、政府の意向に沿わないガバナンスを持つ技術は、供給網から排除される可能性があるという前例を作りました。

日本の開発現場への影響

日本のエンジニアや企業にとっても、他人事ではありません。多くの日本企業がClaudeのAPIを業務に活用していますが、今回の「サプライチェーン・リスク」指定により、以下の影響が懸念されます。

- 外資系企業や政府案件での制約: 米国政府と取引のある日本企業において、Anthropic製品の利用を自粛する動きが出る可能性があります。

- マルチモデル戦略の加速: 特定のプロバイダーに依存するリスクが顕在化したため、GPT-4oやGemini、あるいはLlamaといったオープンモデルを併用する「マルチモデル構成」への移行が急務となるでしょう。

- 安全性と性能の天秤: 日本国内でも、AIの倫理規制と活用のバランスについて、より現実的な議論が求められるようになります。

ちょっと気になる点

客観的に見て懸念されるのは、この決定が「AIの安全性研究」を萎縮させてしまう可能性です。Anthropicは安全性を最大の強みとして成長してきた企業であり、その方針が「リスク」と見なされることは、他のAI企業にとっても大きなプレッシャーとなります。

また、連邦政府という巨大な顧客を失うことで、同社の研究開発資金や優秀な人材の流出が起きないかという点も注目されます。一方で、政府が特定の企業を排除することで、結果として他国のAI技術や、制御の及ばないオープンソースモデルへの依存が高まってしまうという皮肉な結果を招くリスクも否定できません。

試してみたいポイント

このニュースを受けて、開発者や意思決定者が今すぐ検討すべきアクションは以下の通りです。

- フォールバック体制の構築: 開発中のシステムでClaude APIを使用している場合、他のLLMへ即座に切り替えられる抽象化レイヤー(LangChainの活用など)を実装しておく。

- 利用規約とコンプライアンスの再確認: 自社のクライアントが米国政府関連である場合、特定のAIベンダーの利用制限に関する条項が含まれていないか確認する。

- ローカルLLMの検証: 外部ベンダーの政治的リスクに左右されない選択肢として、Llama 3などの高性能なオープンウェイトモデルを自社サーバーで運用するコストと性能を試算しておく。

まとめ

トランプ政権によるAnthropicの利用停止命令は、AIの倫理と国家の論理が決定的に決裂した瞬間といえます。今後は、技術的な性能だけでなく、その開発企業がどの国のどのような政治的スタンスに近いかが、選定の重要な基準になっていくのかもしれません。

なぜ重要?

民間企業が掲げる「AIの安全性」という理想が、国家安全保障という現実の壁に突き当たった象徴的な出来事だからです。この対立の結果は、今後のAI規制のあり方や、グローバルな技術供給網の再編に決定的な影響を与えることになります。

一次ソース

用語メモ

- サプライチェーン・リスク: 製品やサービスの供給網において、特定の企業が安全保障上の脅威となる可能性のこと。指定されると政府調達から排除される。

- Constitutional AI (憲法的AI): AIに特定の「憲法(原則)」を学習させ、人間が細かく指示しなくても自律的に倫理的な判断を行わせるAnthropic独自の手法。

- ガードレール: AIが不適切な回答や危険な情報を生成しないように設定された制限機能。

- 連邦機関: アメリカの中央政府に属する各省庁や組織の総称。