3行でわかる今回のニュース

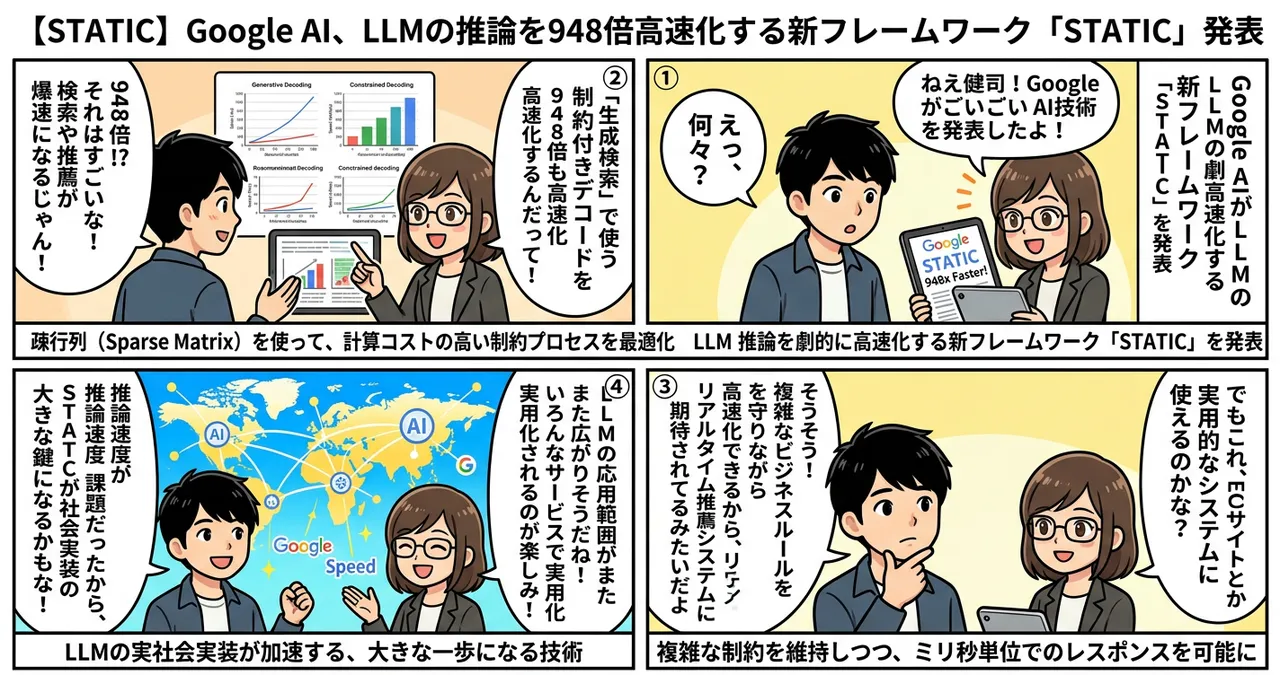

- Googleの研究チームが、LLMの推論速度を劇的に向上させる新フレームワーク「STATIC」を発表。

- 生成検索における制約付きデコードにおいて、従来の手法と比較して最大948倍の高速化を実現した。

- ビジネスロジックなどの複雑な制約を維持しながら、実用的な推薦システムへの応用が可能になる。

もうちょっと詳しく

生成検索の課題を「疎行列」で解決

Google AIが発表した「STATIC」は、大規模言語モデル(LLM)を用いた「生成検索(Generative Retrieval)」の効率を根本から改善する技術です。生成検索とは、従来の検索エンジンのようにインデックスから文書を探すのではなく、モデルが直接「文書ID」を生成する手法を指します。

この手法では、モデルが「実在しないID」や「ビジネスルールに反する回答」を出力しないよう、出力可能なトークンを制限する「制約付きデコード」が必要です。しかし、このプロセスは計算負荷が非常に高く、実用化の大きな壁となっていました。STATICは、この制約プロセスを「疎行列(Sparse Matrix)」の演算として定式化することで、GPU上での並列処理を最適化し、ボトルネックを解消しています。

なにがすごいの?

圧倒的なデコード速度の向上

従来の制約付きデコード手法では、各ステップで有効なトークンを逐一フィルタリングするため、シーケンスが長くなるほど処理が重くなる傾向にありました。STATICは、制約条件を事前に疎行列形式で表現し、推論時に高速な行列演算として実行します。

| 指標 | 従来手法 | STATIC | 改善率 |

|---|---|---|---|

| デコード速度 | 標準的 | 最大948倍 | 劇的向上 |

| ビジネスロジック適用 | 困難・低速 | 容易・高速 | 大幅改善 |

| 大規模データ対応 | 限界あり | 高いスケーラビリティ | 実用レベル |

この技術により、数百万件のアイテムから成る推薦システムにおいても、LLMの表現力を活かしたまま、ミリ秒単位でのレスポンスが可能になると期待されています。

日本の開発現場への影響

リアルタイム推薦システムの変革

日本のECサイトや動画配信プラットフォームにおいて、パーソナライズされた推薦は売上に直結する重要な機能です。これまでLLMを推薦エンジンに組み込む試みは多くなされてきましたが、応答速度の遅さが課題となり、リアルタイムな環境での導入は見送られるケースも少なくありませんでした。

STATICの登場により、複雑な在庫状況やユーザー属性に応じたビジネスルールを遵守しつつ、高速な推薦を実現できる可能性が高まります。特に、モバイルアプリなど低遅延が求められるサービスを展開する日本のエンジニアにとって、実装の選択肢を広げる重要な技術となるでしょう。

ちょっと気になる点

実装の複雑さとメモリ消費

非常に高いパフォーマンスを誇るSTATICですが、疎行列フレームワークを既存のLLMパイプラインに統合するためのエンジニアリングコストが懸念されます。また、制約条件を保持するための行列データが、大規模な語彙数やアイテム数を持つシステムにおいて、どの程度のメモリを消費するのかという点も注視すべきでしょう。

現時点では特定のタスク(生成検索)において顕著な成果を上げていますが、より汎用的なテキスト生成タスクにおいて同様の高速化が達成できるかどうかは、今後の研究を待つ必要があります。

試してみたいポイント

- 公開されている論文から、制約条件を疎行列に変換するアルゴリズムの仕組みを把握する。

- 自社の推薦システムにおいて、どのような「ビジネス制約(在庫、カテゴリ制限等)」をデコード時に適用すべきか整理する。

- Googleからオープンソースの実装やライブラリが提供されるか、継続的にウォッチする。

まとめ

LLMの推論コストと速度は、AIの実装における最大の課題であり続けてきました。STATICが示した「948倍」という数字は、生成検索が単なる研究対象から、実社会のインフラへと進化する大きな一歩といえます。検索や推薦のあり方が、今後数年で劇的に変わる予兆を感じさせるニュースです。

なぜ重要?

LLMを実ビジネスで活用する際、応答速度の遅さはユーザー体験を著しく損なう要因となります。STATICのような高速化技術は、AIを「裏側のバッチ処理」から「表側のリアルタイム対話」へと引き出し、社会実装を加速させる鍵となるため非常に重要です。

一次ソース

用語メモ

- 生成検索 (Generative Retrieval): 検索クエリに対して、モデルが直接回答や関連する文書のIDを生成する検索手法のこと。

- 制約付きデコード: LLMがテキストを生成する際、特定のルールや辞書に存在する単語のみを出力するように制限をかける技術。

- 疎行列 (Sparse Matrix): 成分の大部分がゼロである行列のこと。計算機上で効率的に処理するための専用のアルゴリズムが存在する。

- デコード速度: AIが学習済みの知識を用いて、実際に文章や回答を1文字ずつ生成していく際の処理スピード。