3行でわかる今回のニュース

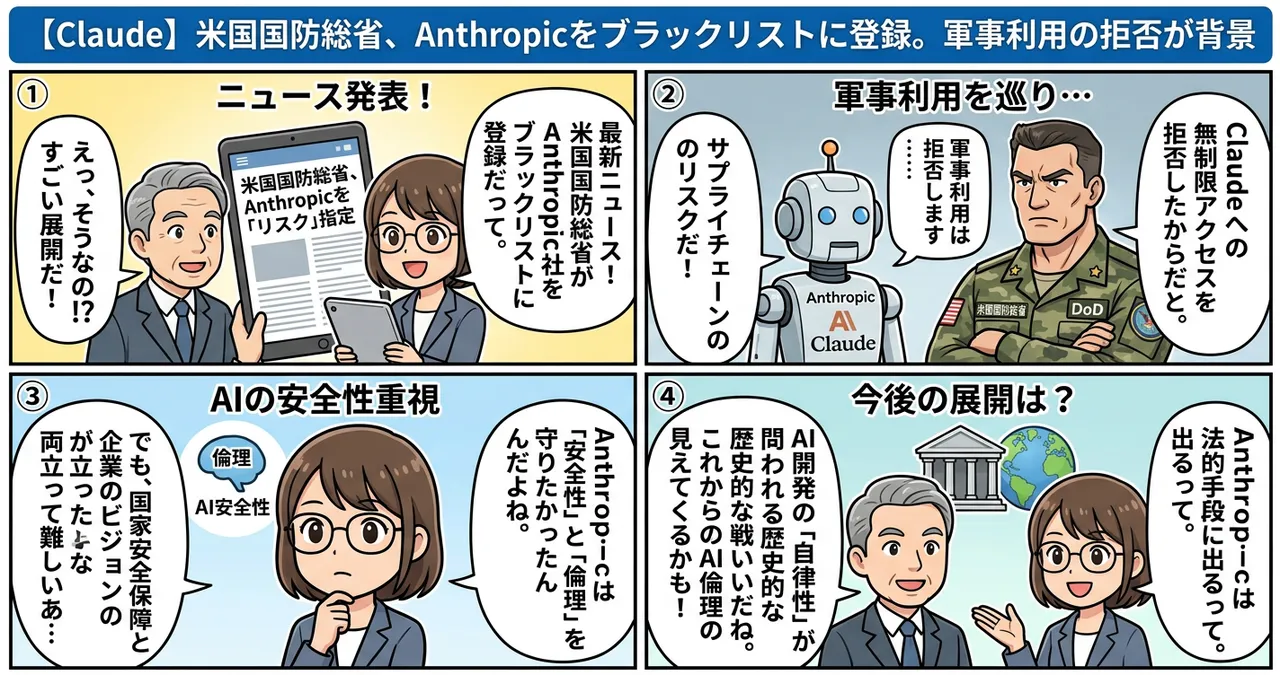

- 米国国防総省が、Anthropic社を「サプライチェーンのリスク」と見なしブラックリストへ登録。

- 軍事作戦や国内監視目的でのAIモデル「Claude」への無制限アクセスの拒否が主な要因。

- Anthropic社は不当な扱いとして、法的手段による対抗措置を講じる意向を表明。

もうちょっと詳しく

米国国防総省(DoD)は、AI開発大手のAnthropic社を「サプライチェーンのリスク」がある企業のリストに登録しました。この決定は、同社が開発する高性能AIモデル「Claude」を、軍事利用や国内監視といった特定の用途に提供することに対し、無制限のアクセスを拒否したことを受けて下されたものです。

この対立は以前から予見されていました。先日行われた【Claude】米国国防総省がAnthropicのCEOを召喚、軍事利用の制御を巡り議論が激化の際にも、安全保障上の要請と企業の倫理指針の間で激しい議論が交わされていました。さらに、政権交代に伴う方針転換により【Anthropic】トランプ大統領、連邦政府機関でのAnthropic製品利用を全面禁止という流れも加速しており、今回のブラックリスト登録は決定的な断絶を意味します。

Anthropic社は「AIの安全性と倫理的利用を優先する」という基本方針を貫いていますが、国防総省側は「国家安全保障に不可欠な技術が、民間企業の恣意的な判断で制限されることは許容できない」という立場を鮮明にしています。

なにがすごいの?

今回の事態は、AI開発企業が国家という巨大な力に対して、自社の「憲法(AIアライメント)」をどこまで守り通せるかという歴史的な試金石となっています。

特に注目すべきは、主要な競合他社との対応の差です。以下の表は、国防総省との協力姿勢を比較したものです。

| 項目 | Anthropic (Claude) | OpenAI (GPT) |

|---|---|---|

| 国防総省との契約 | 拒否・制限あり | 合意済み |

| 軍事ネットワーク利用 | ブラックリスト登録 | 推進中 |

| 主な懸念事項 | 倫理的逸脱、監視への悪用 | 国家安全保障への貢献 |

| 現状のステータス | サプライチェーンリスク指定 | 機密ネットワーク利用で合意 |

Anthropic社が「技術の軍事転用」に明確な一線を引いたことで、AI業界における「安全性」の定義が、単なる技術的課題から地政学的な政治問題へと昇華したといえるでしょう。

日本の開発現場への影響

日本のエンジニアや企業にとって、今回のニュースは決して対岸の火事ではありません。

- サプライチェーンの見直し: 日本企業が米国国防関連のプロジェクトに携わっている場合、ブラックリスト登録された企業のサービス(Claude API等)を使用していることがリスクと見なされる可能性があります。

- プラットフォームの選択: AWS BedrockやGoogle Cloud経由でClaudeを利用している場合でも、米国内の規制が波及し、利用制限やサポートの不透明感が増す恐れが考えられます。

- コンプライアンスの複雑化: AI導入に際し、単なる性能比較だけでなく、開発元の政治的・法的状況まで考慮した選定が求められるようになるでしょう。

ちょっと気になる点

最も懸念されるのは、この対立が「AIの分断」を招くことです。国防総省が特定のAIを排除し、他方のAI(OpenAIなど)を推奨することで、技術の多様性が失われる可能性があります。

また、Anthropic社が法的手段に出ることで、裁判が長期化すれば、同社の資金繰りや研究開発スピードに影響が出ることは避けられません。国家安全保障を理由としたブラックリスト登録は、一度行われると解除のハードルが非常に高く、同社のビジネスモデルそのものが再考を迫られる可能性も否定できないでしょう。

試してみたいポイント

このニュースを受けて、開発者や意思決定者が今すぐ確認すべきアクションです。

- 利用規約の再確認: 自社で利用しているAIサービスの利用規約、特に「禁止されている用途」や「政府への協力姿勢」に関する項目を読み直す。

- マルチモデル運用の検討: 特定のモデルが利用不能になるリスクに備え、複数のAIモデルを切り替えて使用できるアーキテクチャへの移行を検討する。

- 地政学的リスクの評価: 導入しているツールの開発元が、各国の規制やブラックリストに該当していないか、定期的なチェック体制を構築する。

まとめ

AIの倫理と国家の安全保障が真っ向から衝突する形となった今回のブラックリスト登録は、今後のAI開発の在り方を大きく変える分岐点となるでしょう。Anthropic社が展開する法廷闘争の結果次第では、民間企業が保持する技術の「自律性」の限界が定義されることになりそうです。

なぜ重要?

AIが国家のインフラとなりつつある今、開発企業が政府の要請を拒否できるかという問題は、民主主義と技術統治のバランスを問うものです。この決着は、世界中のAI開発基準や供給体制に多大な影響を及ぼします。

一次ソース

用語メモ

- サプライチェーンのリスク: 製品やサービスが手元に届くまでの過程において、サイバー攻撃や政治的要因により供給が途絶えたり、安全性が脅かされたりする可能性のことです。

- ブラックリスト: 特定の目的において、取引や利用を禁止・制限する対象を記した一覧です。

- AIアライメント: AIの目的や行動を、人間の意図や倫理、利益と一致するように調整する技術やプロセスのことです。