3行でわかる今回のニュース

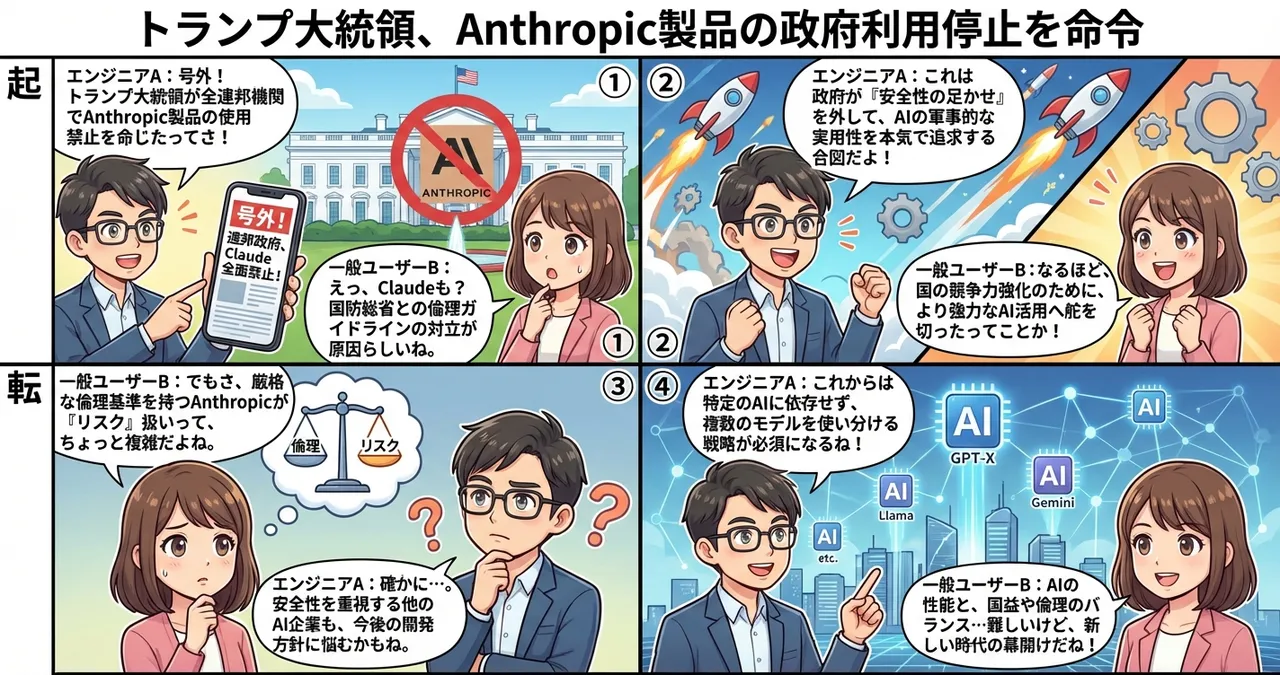

- Anthropicが米国防総省を提訴し、ブラックリスト入りに対する撤回を求めました。

- AIの軍事利用を制限する自社の安全原則を維持することが、提訴の最大の理由です。

- 国家の安全保障とAI企業の倫理的スタンスが真っ向から衝突する事態となっています。

もうちょっと詳しく

提訴の背景と経緯

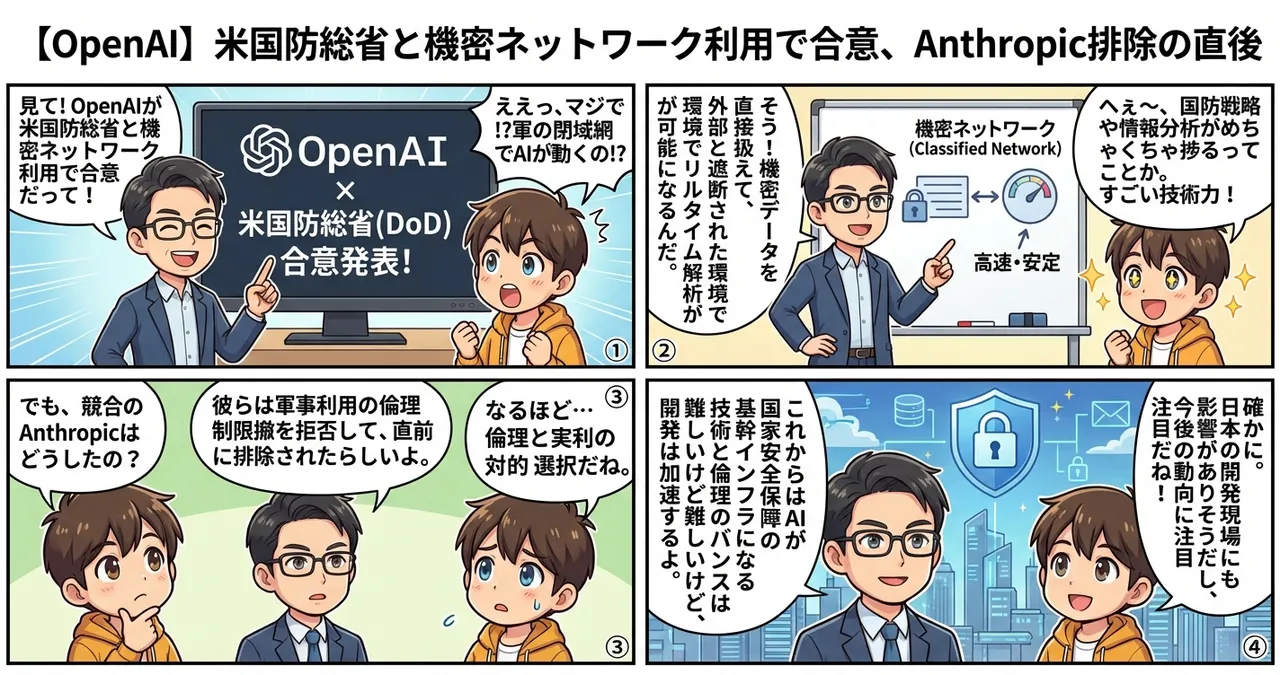

これまで米国国防総省がAnthropicのCEOを召喚、軍事利用の制御を巡り議論が激化したことで、両者の緊張は高まっていました。Anthropicは一貫して米国国防総省の「無制限な軍事利用」要求を拒否、AI倫理の境界線を明確化する姿勢を示してきましたが、今回、政府機関によるブラックリスト指定という強硬手段に対し、法的な対抗措置に打って出た形です。

争点の中心

国防総省側は、最先端AIの軍事転用は国家の優位性を保つために不可欠であると主張しています。一方、Anthropicは「責任あるAI開発」という憲章に基づき、AIが殺傷兵器の自律制御や戦闘判断に関与することを厳格に禁じています。この「技術の安全性」と「国家防衛の必要性」という二つの価値観が、法廷で問われることになりました。

なにがすごいの?

これまで抽象的な議論に留まっていた「AIの倫理原則」が、実際に法的な拘束力を伴う論争へと発展した点が画期的です。

| 項目 | 従来のアプローチ | 今回のケース |

|---|---|---|

| AI利用の是非 | 個別契約での調整 | 法廷を通じた原則の明確化 |

| 企業のスタンス | 協力または黙認 | 安全原則に基づく拒絶と提訴 |

| 影響範囲 | 民間利用が中心 | 国家の安全保障戦略へ直結 |

これまで企業が一方的に政府の要求を受け入れるケースが多かった中、今回の訴訟はAI企業が「倫理」を盾に国家権力と対峙する新たな時代の幕開けといえます。

日本の開発現場への影響

日本のエンジニアや企業にとっても、これは対岸の火事ではありません。特に政府との共同プロジェクトを進める場合、自社が掲げる「AI倫理指針」と「発注元の要求」が相反した際、どのような法的リスクが生じるかを再考するきっかけとなります。今後は、契約書に「倫理的利用の範囲」を詳細に明記する重要性が高まるでしょう。

ちょっと気になる点

現在、トランプ政権下で米国国防総省の「無制限な軍事利用」要求を拒否、AI倫理の境界線を明確化に関連し、トランプ大統領、連邦政府機関でのAnthropic製品利用を全面禁止という措置が取られています。この状況で訴訟が有利に働くのか、あるいはさらに孤立を深めるのか、政治的な逆風が司法判断にどう影響するかが注視されています。

試してみたいポイント

- Anthropicが公開している「憲法AI(Constitutional AI)」の最新ドキュメントを確認し、どのような倫理基準が設定されているか読み解く。

- 自社や自身の開発しているプロジェクトにおいて、AIの悪用を防止するための「技術的防壁」がどこまで備わっているか再確認する。

- 今回の訴訟に関する法廷資料をフォローし、AIの軍事利用に関する国際的な議論の潮流を把握する。

まとめ

テクノロジー企業が自らの信念を守るために国家機関を相手取るという、歴史的な転換点に私たちは立っています。この裁判の結末は、今後のAI開発が「誰のために、どのような目的で許されるのか」という世界のルールを決定づけることになるでしょう。

なぜ重要?

AIが社会インフラや国防の根幹を担うようになる中で、開発企業の「倫理原則」がどこまで効力を持つのかが問われています。このニュースは、AIのガバナンスが単なる社内規定を超え、国家レベルの司法判断に委ねられる時代が到来したことを示しています。

一次ソース

用語メモ

- 憲法AI: AIが自律的に倫理的な判断を行えるよう、開発段階で特定の行動規範(憲法)を学習させる手法。

- 軍事利用の制限: AIモデルが兵器の標的選定や戦闘戦略の策定などに関与することを防ぐための技術的・契約的な制約。

- ブラックリスト: 特定の企業や製品が、政府の公共調達やサービス利用から除外されること。