3行でわかる今回のニュース

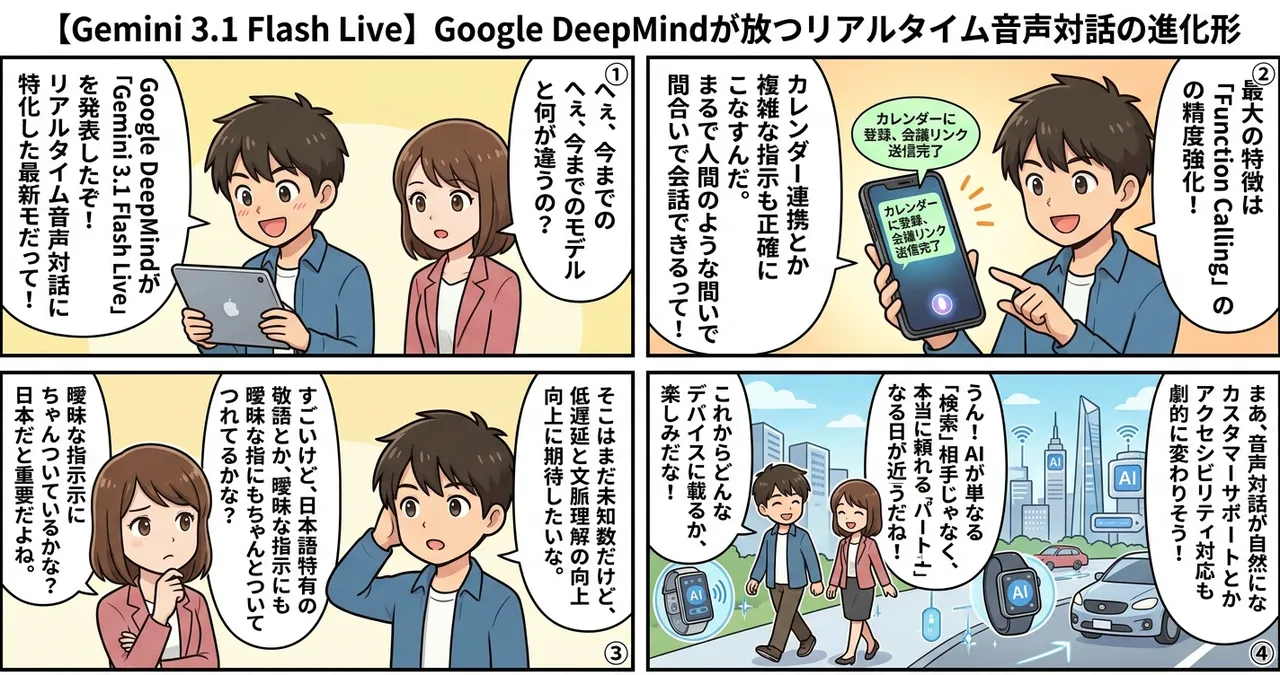

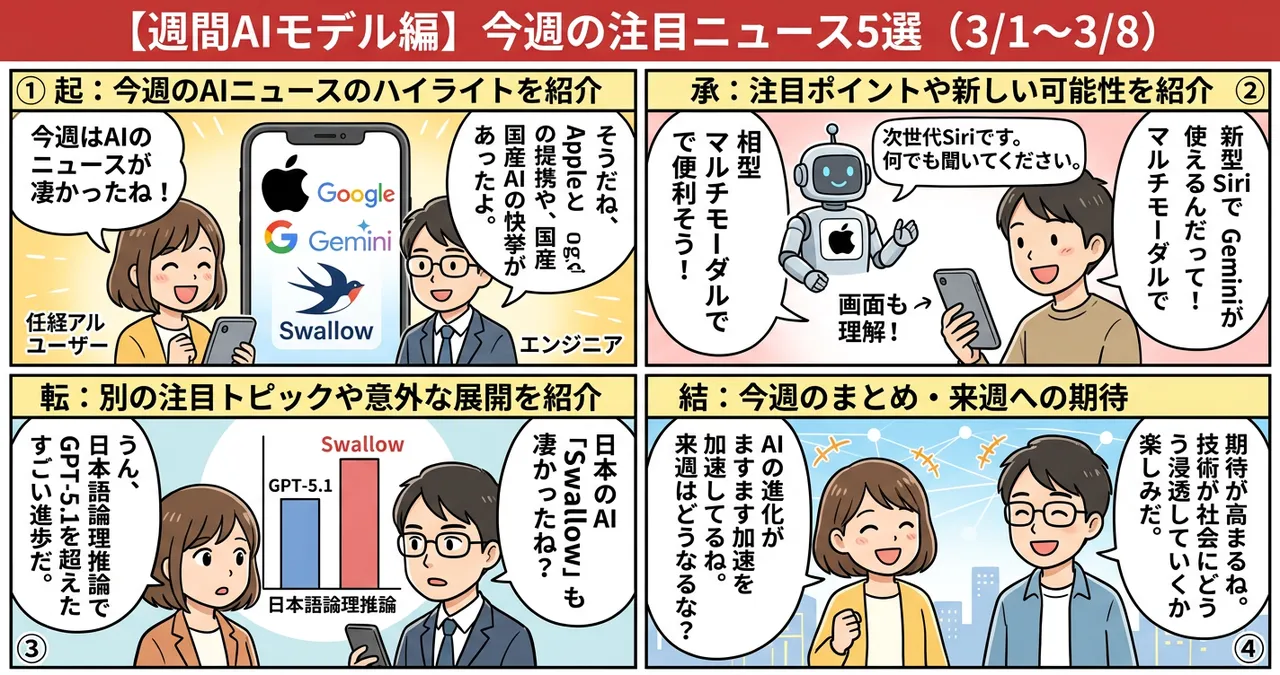

- Google DeepMindが、リアルタイム音声対話に特化した最新モデル「Gemini 3.1 Flash Live」を発表しました。

- 会話の自然さが大幅に向上したほか、外部ツールを呼び出す「Function Calling」の精度が強化されています。

- より人間らしく、かつ実用的なタスク処理をこなせるAIエージェントとしての実用性が高まりました。

もうちょっと詳しく

リアルタイム性と知性の両立

Gemini 3.1 Flash Liveは、従来の音声対応モデルが抱えていた「応答のぎこちなさ」を解消することに焦点を当てています。単に音声を認識してテキストに起こすだけでなく、文脈を即座に理解し、人間同士の会話のようなリズム感で反応を返します。

Function Callingの強化

今回のアップデートで注目すべきは、外部ツールとの連携能力です。例えば「予定を確認して、会議のリンクを送信して」といった指示に対し、カレンダーやメールツールを正確に操作する能力が向上しています。これにより、単なるチャット相手を超えて、タスクを代行するエージェントとしての側面が強化されました。

なにがすごいの?

従来のモデルと比較して、Gemini 3.1 Flash Liveは「遅延の少なさ」と「文脈理解」のバランスが飛躍的に向上しています。

| 特徴 | 従来モデル | Gemini 3.1 Flash Live |

|---|---|---|

| 応答速度 | 比較的速いが機械的 | 人間に近い自然な間合い |

| Function Calling | 複雑な指示で誤作動あり | 高い精度でツールを実行可能 |

| 会話の自然さ | 途切れがち | 文脈を維持した流暢な対話 |

この技術は、Googleが以前発表した 【Genie 3.0】Google DeepMindが放つ「数分間崩れない」次世代3D世界モデル のような没入型体験と組み合わせることで、より高度なインタラクティブ環境を構築する基盤となり得るでしょう。

日本の開発現場への影響

日本のエンジニアにとって、このモデルの登場は「音声インターフェースの再構築」を意味します。特に、カスタマーサポートやアクセシビリティ対応のアプリケーションにおいて、より低コストで高品質なボイスボットの実装が可能になります。また、日本語特有の敬語や曖昧な指示に対しても、今回の改善によって従来よりも高い追従性が期待できるはずです。

ちょっと気になる点

非常に高性能なモデルですが、リアルタイムで外部ツールを頻繁に呼び出す仕様は、API利用料や計算リソースの消費量に直結します。また、音声対話が自然になればなるほど、ユーザーがAIを「人間」と錯覚してしまうリスクに対する倫理的なガイドラインや、誤作動時の安全性確保がこれまで以上に重要となるでしょう。

試してみたいポイント

- Google AI Studioや対応する開発者向けプラットフォームから、最新のGemini APIを呼び出してみる。

- 複雑なタスク(例:「最新のニュースを要約して、Slackに投稿して」)を音声で指示し、ツール連携の正確さをテストする。

- 意図的に早口や曖昧な言い回しをして、AIがどこまで文脈を汲み取れるか検証する。

まとめ

Gemini 3.1 Flash Liveは、AIとの対話を「検索」から「共生」へと一歩近づける重要なアップデートといえます。今後はこの音声モデルがどのようなデバイスに搭載され、私たちの日常に溶け込んでいくのか、さらなる活用事例から目が離せません。

なぜ重要?

このアップデートは、AIが単なる「情報提供者」から「実行可能なパートナー」へと進化する過程を示しています。音声という最も直感的なインターフェースが洗練されることで、言語や操作の壁を超えた、より広範なユーザーがAIの恩恵を受けられる社会が実現しようとしています。

一次ソース

用語メモ

- Gemini 3.1 Flash Live: Googleが提供する軽量かつ高速な音声対応AIモデル。リアルタイム対話と外部ツール操作に最適化されています。

- Function Calling: AIが外部のプログラムやAPIを呼び出し、特定のタスク(検索、予約、データ送信など)を実行する機能。

- 低遅延(Low Latency): 入力から応答までの時間が短いこと。音声対話において自然さを感じるための最重要指標です。

- エージェント: 指示を受けて自律的に考え、ツールを使用してタスクを完遂するAIの形態。

![[Gemini 3.1 Flash-Lite] Google’s New Ultra-Fast, Low-Cost Model](https://4koma-news.com/images/posts/en/85-2026-03-03-google-gemini-flash-lite-blog.webp)