3行でわかる今回のニュース

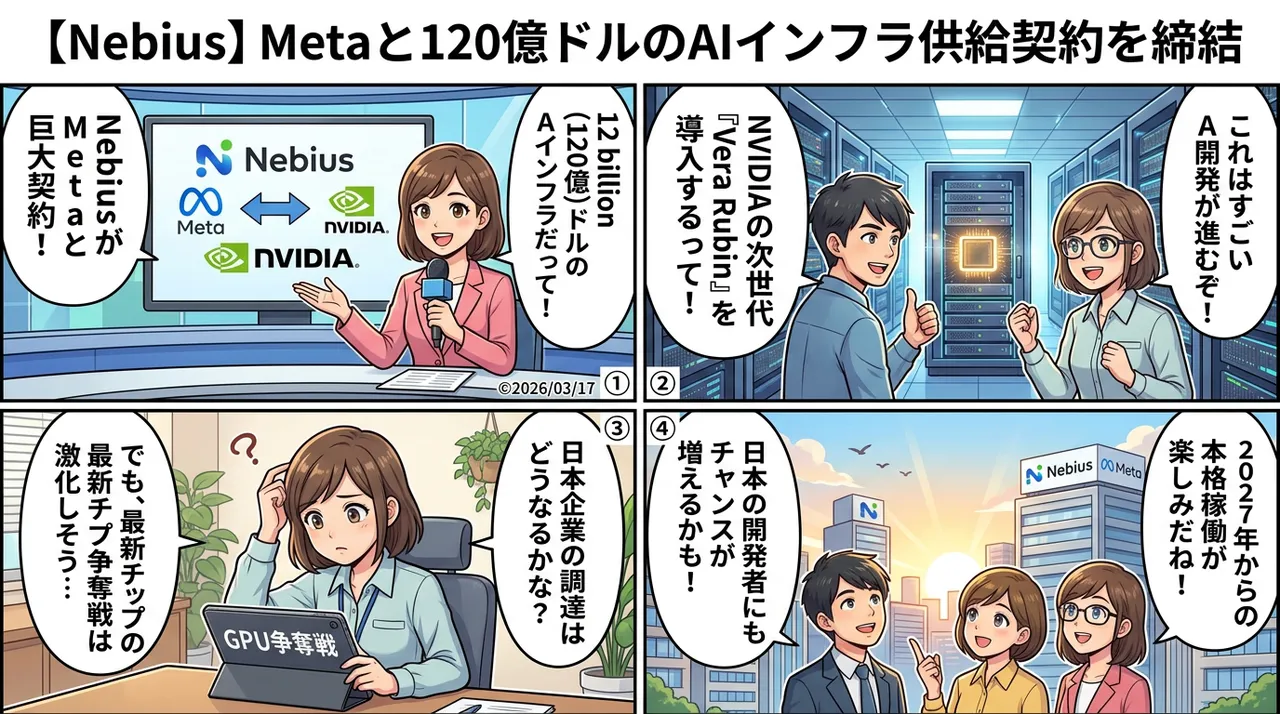

- NVIDIAとMarvellが戦略的提携を結び、次世代AIインフラ構築に向けた協力を強化します。

- NVLink Fusionを通じて、Marvellのネットワーク技術をNVIDIAのAIエコシステムに統合します。

- NVIDIAはMarvellに20億ドルの投資を行い、AIデータセンターの柔軟性と拡張性を飛躍的に高めます。

もうちょっと詳しく

ネットワークと演算の融合

今回の提携の核となるのは「NVLink Fusion」です。これは、NVIDIAの強力なGPUコンピューティング環境と、Marvellが得意とする高速ネットワーク技術をシームレスに連携させるための新しいアプローチといえます。

これまではGPU内部での通信と、データセンター全体でのネットワーク通信は別々に最適化される傾向がありました。しかし、モデルの大規模化に伴い、ネットワークがボトルネックとなるケースが増えています。今回の提携により、Marvellのイーサネットスイッチや光通信技術がNVIDIAのプラットフォームに最適化され、AIインフラ全体のパフォーマンスを一段上のレベルへ引き上げる狙いがあります。

なにがすごいの?

従来型のデータセンター構成と、今回の提携による次世代インフラの違いをまとめました。

| 特徴 | 従来型(標準的な構成) | 新しいエコシステム(NVLink Fusion) |

|---|---|---|

| 接続の柔軟性 | 規格依存で制限が多い | NVIDIA GPUと最適化された統合が可能 |

| スケーラビリティ | ネットワーク構築に時間を要する | 柔軟な拡張性と高速なデータ転送 |

| 開発の容易さ | 個別の最適化が必要 | エコシステム内での自動的な最適化 |

最大のメリットは、数万個規模のGPUをあたかも一つの巨大なコンピューターのように扱える「スケーラビリティ」の確保です。ネットワークの遅延を最小限に抑えることで、AIモデルの学習時間を大幅に短縮できる可能性があります。

日本の開発現場への影響

日本のデータセンター事業者やAI開発企業にとっては、インフラ構築の選択肢が広がることを意味します。これまでNVIDIAのGPUを中心としたシステムを組む際、ネットワーク周りの設計には独自の工夫が必要でしたが、Marvellの技術が統合されることで、より標準化された安定的なAIインフラを導入しやすくなるでしょう。

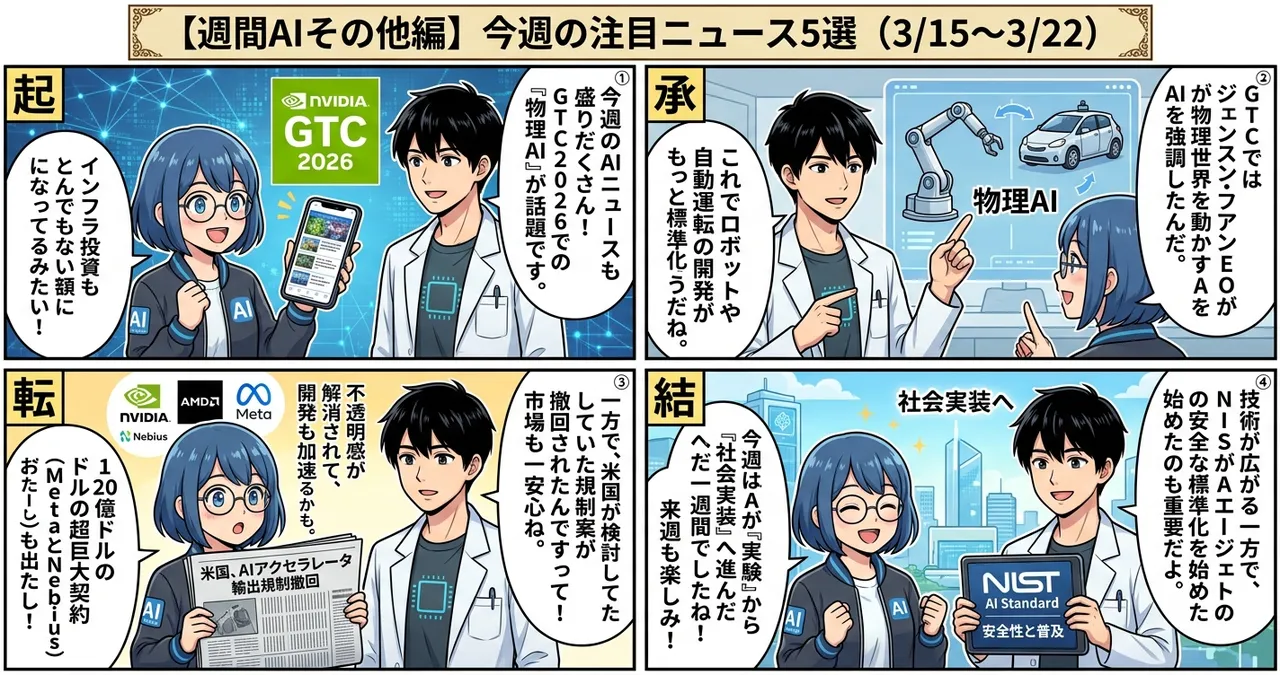

特に、大規模言語モデル(LLM)の自社開発や、産業用AIの導入を進める企業にとって、インフラの構築効率が上がることはコスト削減と開発速度の向上に直結します。先日の【週間AIその他編】今週の注目ニュース5選(3/15〜3/22)でも触れた通り、AIインフラへの投資は世界的に激化しており、日本国内でも最新技術を取り入れた基盤整備が急務となっています。

ちょっと気になる点

提携による恩恵は大きい一方、特定のベンダー(NVIDIA)のエコシステムへの依存度が高まる可能性も指摘されます。オープンな規格であるイーサネットの利点を維持しつつ、いかにNVIDIA独自の最適化とバランスをとるかが、今後の普及の鍵となるでしょう。また、20億ドルという巨額の投資が、短期間でどれだけのパフォーマンス改善として還元されるのか、実際の導入事例が待たれるところです。

試してみたいポイント

- NVIDIAの公式サイトやMarvellのプレスリリースを読み、提供される新しいネットワークアーキテクチャの構成図を確認する。

- 開発環境のネットワーク・ボトルネックを再検証し、将来的なアップグレード計画に今回の技術が適用可能か検討する。

- AIインフラの最新トレンドを追うため、両社の技術ドキュメントやホワイトペーパーを定期的にチェックする。

まとめ

NVIDIAとMarvellの協力関係は、AIインフラのボトルネックを解消するための強力な一手となりそうです。計算資源だけでなくネットワークまでを一体化して最適化する動きは、今後のAI開発の標準となっていくことでしょう。

なぜ重要?

AIモデルの巨大化に伴い、単一のGPUの性能以上に「GPU間をいかに効率よく繋ぐか」がAIの進化を左右する時代となりました。今回の提携は、演算能力と通信能力の融合を加速させ、次世代AIインフラの構築スピードを劇的に変える重要な転換点です。

一次ソース

用語メモ

- NVLink: NVIDIAが開発した、GPU同士を高速で接続するための独自バス規格。

- AIインフラ: AIモデルの学習や推論を実行するために必要な、サーバー、ストレージ、ネットワークなどのシステム基盤。

- スケーラビリティ: システムの規模が大きくなっても、柔軟に拡張し性能を維持できる能力。

- イーサネット: LANなどで広く使われている標準的なネットワーク通信規格。