3行でわかる今回のニュース

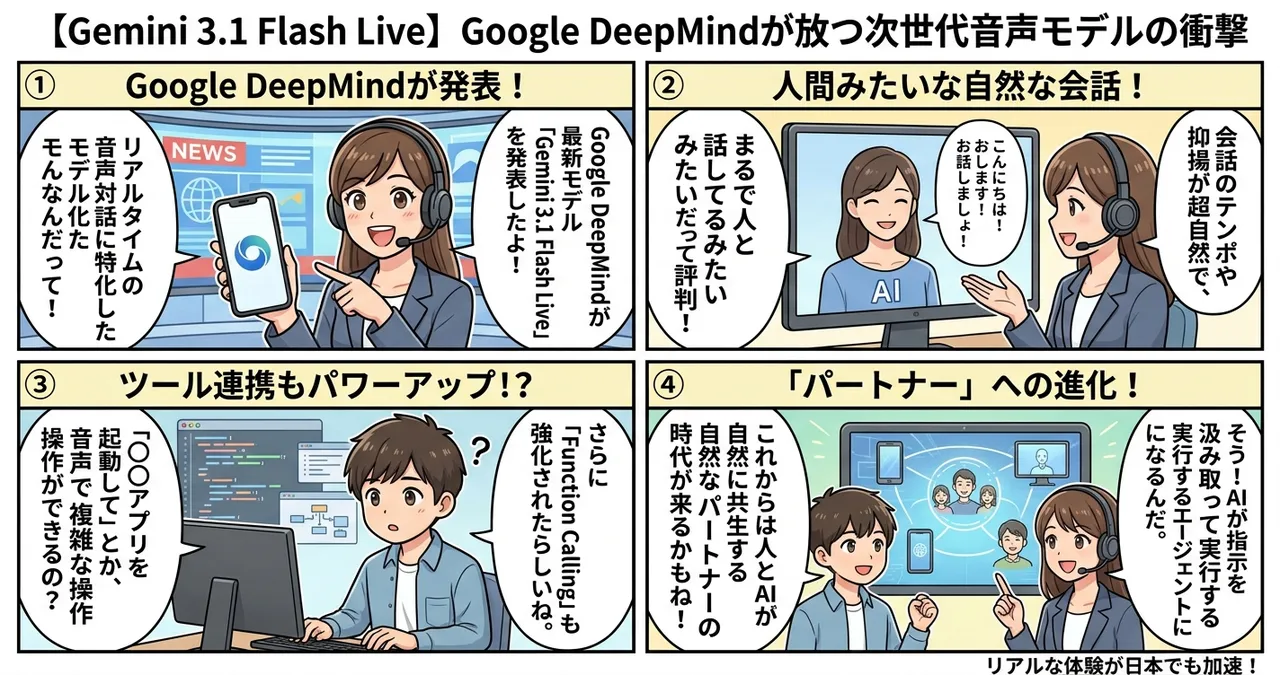

- Google DeepMindが最新の音声特化モデル「Gemini 3.1 Flash Live」を発表しました。

- 会話の自然さが飛躍的に向上し、人間のようなスムーズなやり取りが可能になっています。

- 外部ツールを呼び出す機能(Function Calling)が強化され、実用的なタスク処理能力が大幅に高まりました。

もうちょっと詳しく

音声体験の刷新

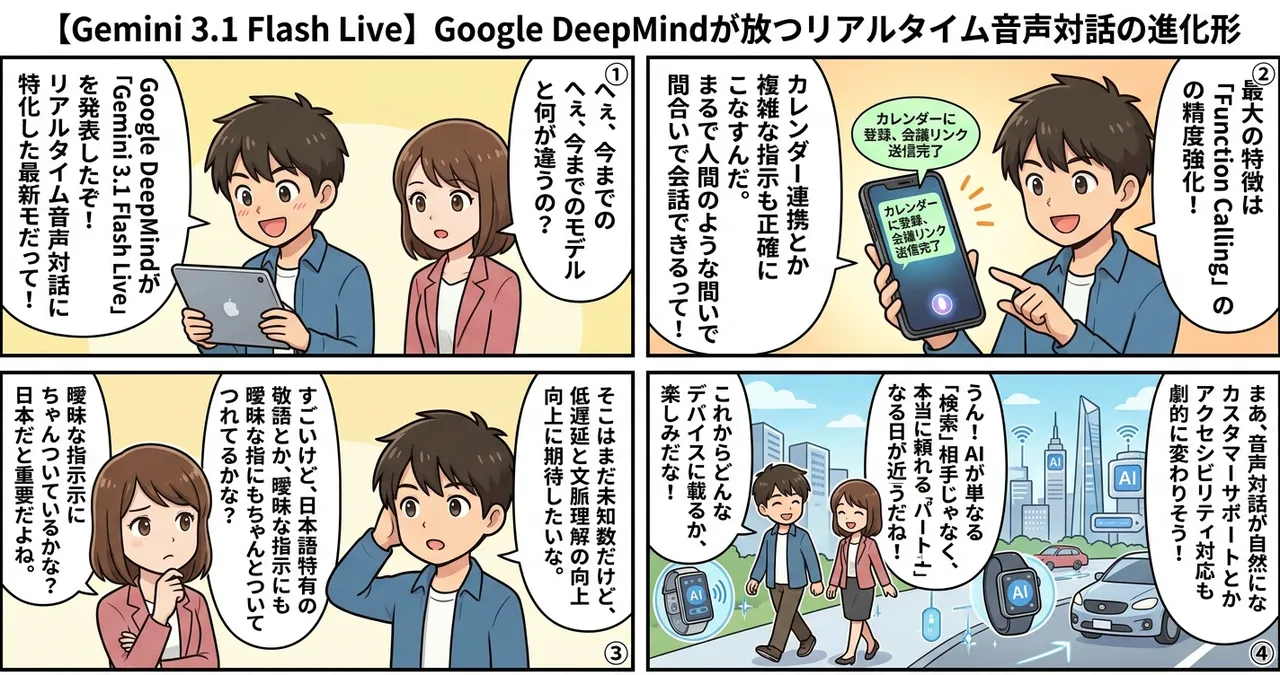

Gemini 3.1 Flash Liveは、リアルタイムの音声対話に特化して設計されています。これまでの音声AIにありがちだった「機械的な間」や「不自然な抑揚」が大幅に改善されており、まるで隣にいる人間と話しているかのような流暢さを実現しました。

ツール連携の深化

単に会話ができるだけでなく、外部のAPIやソフトウェアを操作する「Function Calling」の精度が向上しています。カレンダーへの予定追加や、複雑なデータ検索、さらには特定のアプリケーションを制御する指示を、音声入力だけで正確に実行できるようになりました。

なにがすごいの?

従来のモデルと比較して、特に「反応の質」と「実用性」が進化しています。

| 特徴 | 従来のモデル | Gemini 3.1 Flash Live |

|---|---|---|

| 会話の自然さ | 応答に遅延あり | リアルタイムで非常に滑らか |

| 指示の正確性 | 複雑なタスクで誤認識 | 高度な推論で正確に実行 |

| ツール連携 | 限定的 | 複雑な外部API操作に対応 |

この進化により、単なるチャットボットから、ユーザーの意図を汲み取って行動する「エージェント型」のインターフェースへと大きく舵を切ったといえます。

日本の開発現場への影響

日本のエンジニアにとって、このアップデートは「音声UI」を前提としたアプリケーション開発のハードルを大きく下げるものです。特に、カスタマーサポートの自動化や、高齢者向けの対話型AIアシスタントの開発において、より人間らしい体験を提供できるようになります。

また、【Genie 3.0】Google DeepMindが放つ「数分間崩れない」次世代3D世界モデルのように、映像や空間認識を伴う技術との統合が進めば、音声と視覚情報を組み合わせた高度なUXデザインが日本国内でも加速するでしょう。

ちょっと気になる点

非常に高性能なモデルですが、リアルタイム性が向上した分、推論コストやレイテンシの管理が課題となります。また、音声対話が自然になればなるほど、ユーザー側が「相手が人間である」と錯覚しやすくなるため、AIであることを明示するUX設計や安全性の確保が一層重要になります。

試してみたいポイント

- Google AI Studioなどの開発環境から、最新のGemini 3.1 Flash Live APIを呼び出してみる。

- 複雑な条件分岐を含むタスクを音声で指示し、Function Callingが正しく動作するか検証する。

- 既存の音声対話アプリを本モデルに差し替え、ユーザー体験がどれほど向上するか比較テストを行う。

まとめ

Gemini 3.1 Flash Liveの登場は、AIと人間の距離を物理的にも心理的にも大きく縮める転換点となるでしょう。今後は、この高度な対話能力をいかに実社会の複雑なワークフローに組み込んでいくか、開発者の腕の見せ所となりそうです。

なぜ重要?

このニュースは、AIが「テキストを処理するツール」から「人間と自然に共生するパートナー」へと進化していることを象徴しています。リアルタイムの音声対話と確実なツール実行が結びつくことで、PCやスマートフォンの操作体験そのものが根本から覆る可能性を秘めているからです。

一次ソース

用語メモ

- Flashモデル: 高速な応答性と低コストを重視して設計されたモデル群。軽量ながら高度な推論能力を維持しています。

- Function Calling: AIが外部のプログラムやAPIを特定の手順で呼び出し、情報を取得したり操作を実行したりする機能です。

- レイテンシ: ユーザーが指示を出してからAIが応答を開始するまでの時間的遅延のこと。会話の自然さを決定づける重要な指標です。

![[Gemini 3.1 Flash-Lite] Google’s New Ultra-Fast, Low-Cost Model](https://4koma-news.com/images/posts/en/85-2026-03-03-google-gemini-flash-lite-blog.webp)